Actualités des produits

Inférence hybride expérimentale et nouveaux modèles Gemini pour Android

3 minutes de lecture

Si vous êtes un développeur Android et que vous souhaitez implémenter des fonctionnalités d'IA innovantes dans votre application, nous avons récemment lancé de nouvelles mises à jour puissantes :

- L'inférence hybride, une nouvelle API pour Firebase AI Logic qui exploite l'inférence sur l'appareil et dans le cloud,

- La prise en charge de nouveaux modèles Gemini, y compris les derniers modèles Nano Banana pour la génération d'images.

C'est parti !

Tester l'inférence hybride

Avec la nouvelle API Firebase pour l'inférence hybride, nous avons implémenté une approche de routage simple basée sur des règles comme solution initiale pour vous permettre d'utiliser l'inférence sur l'appareil et dans le cloud via une API unifiée. Nous prévoyons de fournir des fonctionnalités de routage plus sophistiquées à l'avenir.

Elle permet à votre application de basculer dynamiquement entre Gemini Nano, qui s'exécute localement sur l'appareil, et les modèles Gemini hébergés dans le cloud. L'exécution sur l'appareil utilise l'API Prompt de ML Kit. L'inférence dans le cloud est compatible avec tous les modèles Gemini de Firebase AI Logic dans Vertex AI et l'API Developer.

Pour l'utiliser, ajoutez les firebase-ai-ondevice dépendances à votre application avec Firebase AI Logic :

dependencies { [...] implementation("com.google.firebase:firebase-ai:17.10.1") implementation("com.google.firebase:firebase-ai-ondevice:16.0.0-beta01") }

Lors de l'initialisation, vous créez une instance GenerativeModel et la configurez avec des modes d'inférence spécifiques, tels que PREFER_ON_DEVICE (qui revient au cloud si Gemini Nano n'est pas disponible sur l'appareil) ou PREFER_IN_CLOUD (qui revient à l'inférence sur l'appareil en cas de déconnexion) :

val model = Firebase.ai(backend = GenerativeBackend.googleAI()) .generativeModel( modelName = "gemini-3.1-flash-lite", onDeviceConfig = OnDeviceConfig( mode = InferenceMode.PREFER_ON_DEVICE ) ) val response = model.generateContent(prompt)

L'API Firebase pour l'inférence hybride pour Android est encore expérimentale. Nous vous encourageons à l'essayer dans votre application, en particulier si vous utilisez déjà Firebase AI Logic.

Actuellement, les modèles sur l'appareil sont spécialisés dans la génération de texte en une seule étape basée sur des entrées de texte ou d'image Bitmap unique. Pour en savoir plus, consultez les limites.

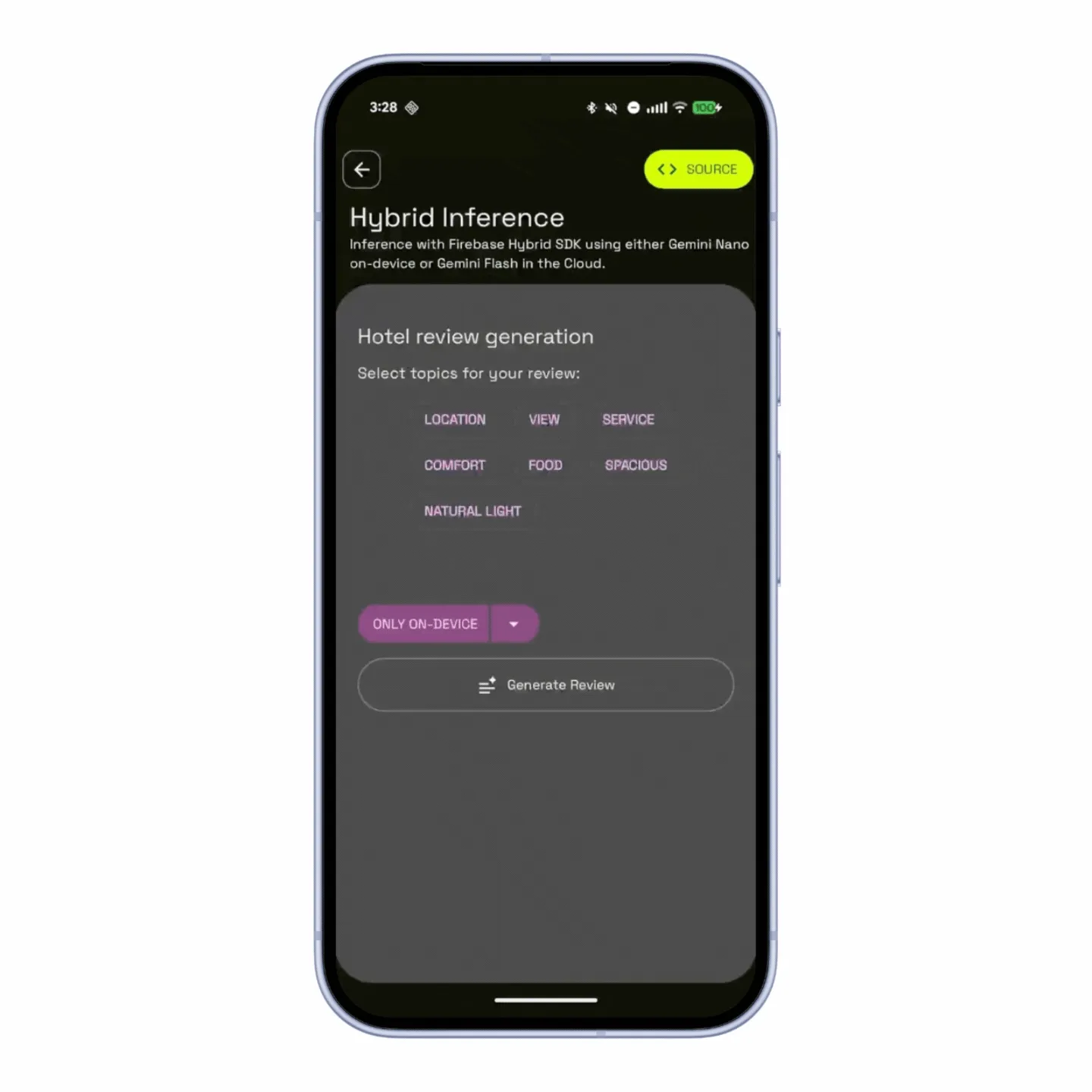

Nous venons de publier un nouvel exemple dans le catalogue d'exemples d'IA qui exploite l'API Firebase pour l'hybride. Il montre comment l'API Firebase pour l'inférence hybride peut être utilisée pour générer un avis basé sur quelques sujets sélectionnés, puis le traduire dans différentes langues. Consultez le code pour le voir en action.

Le nouvel exemple d'inférence hybride en action

Essayer nos nouveaux modèles

Dans le cadre des nouveaux modèles Gemini, nous avons lancé deux modèles particulièrement utiles aux développeurs Android et faciles à intégrer dans votre application via le SDK Firebase AI Logic.

Nano Banana

L'année dernière, nous avons lancé Nano Banana, un modèle de génération d'images de pointe. Et il y a quelques semaines, nous avons lancé deux nouveaux modèles Nana Banana.

Nano Banana Pro (Gemini 3 Pro Image) est conçu pour la production d'assets professionnels et peut afficher du texte haute fidélité, même dans une police spécifique ou en simulant différents types d'écriture manuscrite.

_Nano Banana 2 (Gemini 3.1 Flash Image)_ est l'équivalent haute efficacité de Nano Banana Pro. Il est optimisé pour la vitesse et les cas d'utilisation à volume élevé. Il peut être utilisé pour un large éventail de cas d'utilisation (infographies, autocollants virtuels, illustrations contextuelles, etc.).

Les nouveaux modèles Nano Banana exploitent des connaissances du monde réel et des capacités de raisonnement approfondies pour générer des images précises et détaillées.

Nous avons mis à jour notre exemple Magic Selfie (utilisez la génération d’images pour modifier l’arrière-plan de votre selfie) afin d’utiliser Nano Banana 2. La segmentation de l'arrière-plan est désormais gérée directement avec le modèle de génération d'images, ce qui facilite l'implémentation et permet à Nano Banana 2 d'améliorer ses capacités de génération d'images. Découvrez-le en action ici.

Vous pouvez l'utiliser via le SDK Firebase AI Logic. Pour en savoir plus, consultez la documentation Android.

Gemini 3.1 Flash-Lite

Nous avons également lancé Gemini 3.1 Flash-Lite, une nouvelle version de la famille Gemini Flash-Lite. Les modèles Gemini Flash-Lite sont particulièrement appréciés des développeurs Android pour leur bon rapport qualité/latence et leur faible coût d'inférence. Ils sont utilisés par les développeurs Android pour divers cas d'utilisation, tels que la traduction de messages dans l'application ou la génération d'une recette à partir d'une photo d'un plat.

Gemini 3.1 Flash-Lite, actuellement en preview, permettra des cas d'utilisation plus avancés avec une latence comparable à celle de Gemini 2.5 Flash-Lite.

Pour en savoir plus sur ce modèle, consultez la documentation Firebase.

Conclusion

C'est le moment idéal pour découvrir le nouvel exemple hybride de notre catalogue afin de voir ces fonctionnalités en action et de comprendre les avantages du routage entre l'inférence sur l'appareil et dans le cloud. Nous vous encourageons également à consulter notre documentation pour tester les nouveaux modèles Gemini.

Lire la suite

-

Actualités des produits

Aujourd'hui, nous élargissons la famille de modèles Gemini 3 avec le lancement de Gemini 3 Flash, une intelligence de pointe conçue pour la rapidité à un coût bien inférieur.

Thomas Ezan • 2 minutes de lecture

-

Actualités des produits

L'ajout d'images personnalisées à votre application peut améliorer et personnaliser considérablement l'expérience utilisateur, et renforcer l'engagement des utilisateurs.

Thomas Ezan, Mozart Louis • 5 minutes de lecture

-

Actualités des produits

Android Studio Panda 4 est désormais stable et prêt à être utilisé en production. Cette version apporte le mode de planification, la prédiction de la prochaine modification et bien plus encore, ce qui facilite plus que jamais la création d'applications Android de haute qualité.

Matt Dyor • 5 minutes de lecture

Restez informé

Recevez chaque semaine les dernières informations sur le développement Android directement dans votre boîte de réception.