Tin tức về sản phẩm

Suy luận kết hợp thử nghiệm và các mô hình Gemini mới cho Android

Đọc trong 3 phút

Nếu là nhà phát triển Android và muốn triển khai các tính năng AI cải tiến vào ứng dụng của mình, thì gần đây chúng tôi đã ra mắt những nội dung cập nhật mới mạnh mẽ:

- Suy luận kết hợp, một API mới cho Firebase AI Logic để tận dụng cả suy luận trên thiết bị và suy luận trên đám mây,

- Hỗ trợ các mô hình Gemini mới, bao gồm cả các mô hình Nano Banana mới nhất để tạo hình ảnh.

Cùng bắt đầu nhé!

Thử nghiệm với suy luận kết hợp

Với Firebase API mới cho suy luận kết hợp, chúng tôi đã triển khai một phương pháp định tuyến dựa trên quy tắc đơn giản làm giải pháp ban đầu để cho phép bạn sử dụng cả suy luận trên thiết bị và suy luận trên đám mây thông qua một API hợp nhất. Chúng tôi dự định sẽ cung cấp các chức năng định tuyến phức tạp hơn trong tương lai.

Nhờ đó, ứng dụng của bạn có thể chuyển đổi linh hoạt giữa Gemini Nano chạy cục bộ trên thiết bị và các mô hình Gemini được lưu trữ trên đám mây. Hoạt động thực thi trên thiết bị sử dụng Prompt API của Bộ công cụ học máy. Tính năng suy luận trên đám mây hỗ trợ tất cả các mô hình Gemini từ Firebase AI Logic trong cả Vertex AI và Developer API.

Để sử dụng tính năng này, hãy thêm các phần phụ thuộc firebase-ai-ondevice vào ứng dụng của bạn cùng với Firebase AI Logic:

dependencies { [...] implementation("com.google.firebase:firebase-ai:17.10.1") implementation("com.google.firebase:firebase-ai-ondevice:16.0.0-beta01") }

Trong quá trình khởi tạo, bạn sẽ tạo một thực thể GenerativeModel và định cấu hình thực thể đó bằng các chế độ suy luận cụ thể, chẳng hạn như PREFER_ON_DEVICE (quay lại đám mây nếu Gemini Nano không có trên thiết bị) hoặc PREFER_IN_CLOUD (quay lại suy luận trên thiết bị nếu không có mạng):

val model = Firebase.ai(backend = GenerativeBackend.googleAI()) .generativeModel( modelName = "gemini-3.1-flash-lite", onDeviceConfig = OnDeviceConfig( mode = InferenceMode.PREFER_ON_DEVICE ) ) val response = model.generateContent(prompt)

API Firebase để suy luận kết hợp cho Android vẫn đang trong giai đoạn thử nghiệm. Bạn nên dùng thử API này trong ứng dụng của mình, đặc biệt là nếu bạn đang sử dụng Firebase AI Logic.

Hiện tại, các mô hình trên thiết bị được chuyên biệt hoá để tạo văn bản một lượt dựa trên văn bản hoặc đầu vào là một hình ảnh Bitmap. Hãy xem các hạn chế để biết thêm thông tin chi tiết.

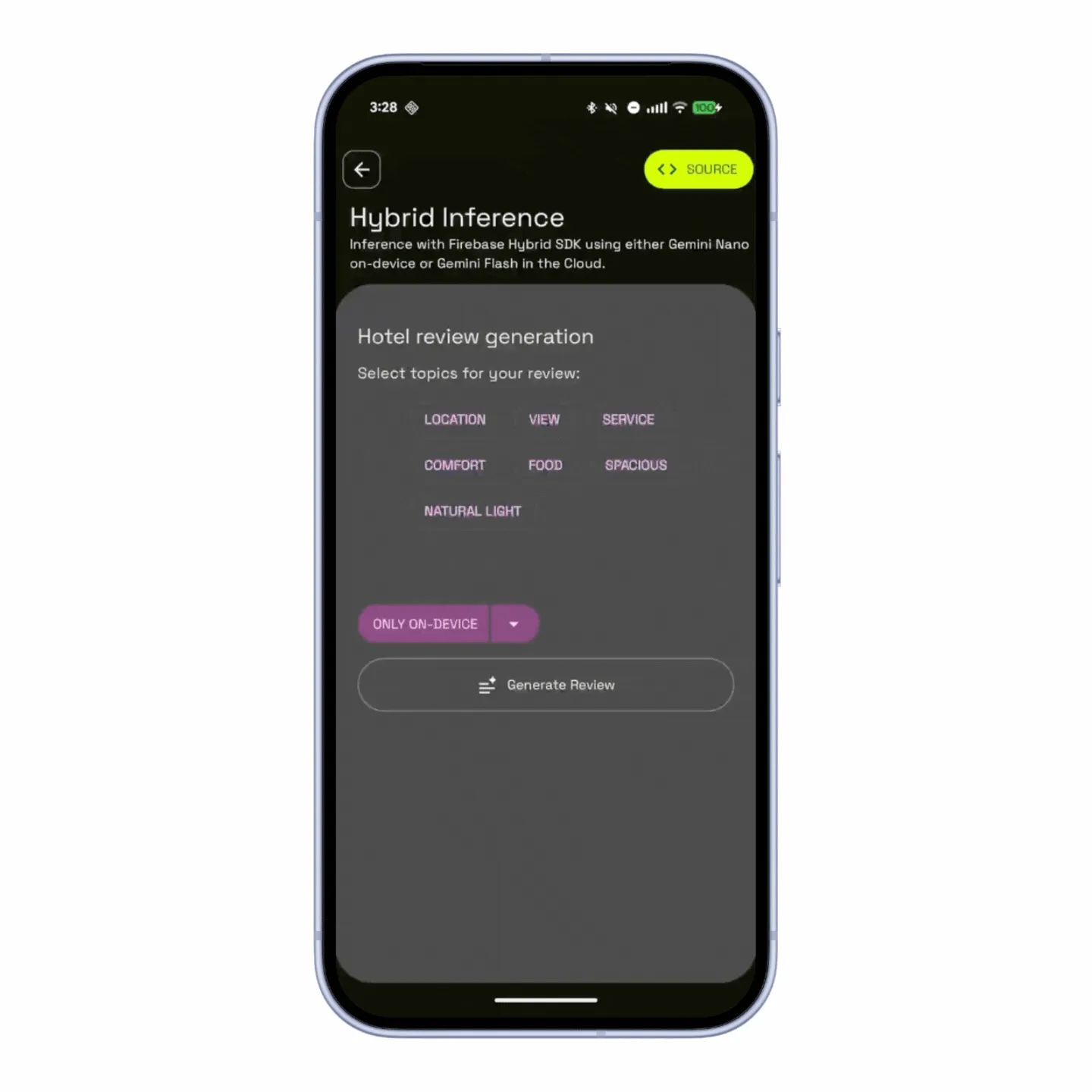

Chúng tôi vừa xuất bản một mẫu mới trong Danh mục mẫu AI, tận dụng API Firebase cho suy luận kết hợp. Mẫu này minh hoạ cách sử dụng API Firebase cho suy luận kết hợp để tạo một bài đánh giá dựa trên một số chủ đề đã chọn, sau đó dịch bài đánh giá đó sang nhiều ngôn ngữ. Hãy xem đoạn mã để thấy cách hoạt động của mã này!

Mẫu suy luận kết hợp mới đang hoạt động

Dùng thử các mô hình mới của chúng tôi

Trong nhóm mô hình Gemini mới, chúng tôi đã phát hành 2 mô hình đặc biệt hữu ích cho nhà phát triển Android và dễ dàng tích hợp vào ứng dụng của bạn thông qua Firebase AI Logic SDK.

Nano Banana

Năm ngoái, chúng tôi đã phát hành Nano Banana, một mô hình tạo ảnh tiên tiến. Vài tuần trước, chúng tôi đã phát hành một số mô hình Nana Banana mới.

Nano Banana Pro (Hình ảnh do Gemini 3 Pro tạo) được thiết kế để tạo ra các thành phần chuyên nghiệp và có thể hiển thị văn bản có độ trung thực cao, ngay cả trong một phông chữ cụ thể hoặc mô phỏng nhiều kiểu chữ viết tay.

Nano Banana 2 (Hình ảnh Gemini 3.1 Flash) là phiên bản hiệu suất cao của Nano Banana Pro. API này được tối ưu hoá cho tốc độ và các trường hợp sử dụng có khối lượng lớn. Bạn có thể sử dụng công cụ này cho nhiều trường hợp sử dụng (bản đồ hoạ thông tin, hình dán ảo, hình minh hoạ theo bối cảnh, v.v.).

Các mô hình Nano Banana mới tận dụng kiến thức thực tế và khả năng suy luận sâu sắc để tạo ra những hình ảnh chính xác và chi tiết.

Chúng tôi đã cập nhật mẫu ảnh selfie ảo (sử dụng tính năng tạo hình ảnh để thay đổi phông nền của ảnh selfie!) để sử dụng Nano Banana 2. Giờ đây, việc phân đoạn nền được xử lý trực tiếp bằng mô hình tạo hình ảnh, giúp việc triển khai trở nên dễ dàng hơn và cho phép Nano Banana 2 phát huy khả năng tạo hình ảnh được cải thiện. Xem ví dụ thực tế tại đây.

Bạn có thể sử dụng Gemini qua SDK Firebase AI Logic. Đọc thêm về vấn đề này trong tài liệu về Android.

Gemini 3.1 Flash-Lite

Chúng tôi cũng phát hành Gemini 3.1 Flash-Lite, một phiên bản mới của dòng mô hình Gemini Flash-Lite. Các mô hình Gemini Flash-Lite được các nhà phát triển Android đặc biệt ưa chuộng vì tỷ lệ chất lượng/độ trễ tốt và chi phí suy luận thấp. Các nhà phát triển Android đã sử dụng công cụ này cho nhiều trường hợp sử dụng, chẳng hạn như dịch tin nhắn trong ứng dụng hoặc tạo công thức từ hình ảnh của một món ăn.

Gemini 3.1 Flash-Lite (hiện đang ở giai đoạn xem trước) sẽ hỗ trợ nhiều trường hợp sử dụng nâng cao hơn với độ trễ tương đương với Gemini 2.5 Flash-Lite.

Để tìm hiểu thêm về mô hình này, hãy xem tài liệu của Firebase.

Lời kết

Đây là thời điểm thích hợp để khám phá mẫu Hybrid mới trong danh mục của chúng tôi nhằm xem các khả năng này hoạt động và hiểu rõ lợi ích của việc định tuyến giữa suy luận trên thiết bị và suy luận trên đám mây. Bạn cũng nên xem tài liệu của chúng tôi để thử nghiệm các mô hình Gemini mới.

Tiếp tục đọc

-

Tin tức về sản phẩm

Hôm nay, chúng tôi mở rộng nhóm mô hình Gemini 3 bằng cách phát hành Gemini 3 Flash, một mô hình thông minh đột phá được thiết kế để xử lý nhanh chóng với chi phí thấp hơn.

Thomas Ezan • Đọc trong 2 phút

-

Tin tức về sản phẩm

Việc thêm hình ảnh tuỳ chỉnh vào ứng dụng có thể cải thiện và cá nhân hoá đáng kể trải nghiệm người dùng, đồng thời tăng mức độ tương tác của người dùng.

Thomas Ezan, Mozart Louis • Đọc trong 5 phút

-

Tin tức về sản phẩm

Hệ sinh thái di động không ngừng phát triển, mang đến cả cơ hội và mối đe doạ mới. Thông qua những thay đổi này, Android và Google Play vẫn cam kết đảm bảo rằng hàng tỷ người dùng có thể tiếp tục yên tâm tận hưởng các ứng dụng và hoạt động đổi mới của nhà phát triển có thể phát triển mạnh mẽ.

Vijaya Kaza • Đọc trong 3 phút

Nhận thông tin cập nhật

Nhận thông tin chi tiết mới nhất về hoạt động phát triển trên Android trong hộp thư đến của bạn mỗi tuần.