Actualités sur les produits

Comment l'optimisation automatique des requêtes améliore la qualité de l'API Prompt de ML Kit

3 minutes de lecture

Optimisation automatique des requêtes (APO)

Pour vous aider à déployer vos cas d'utilisation de l'API Prompt de ML Kit en production, nous sommes heureux d'annoncer l'optimisation automatique des requêtes (APO) ciblant les modèles sur l'appareil sur Vertex AI. L'optimisation automatique des requêtes est un outil qui vous aide à trouver automatiquement la requête optimale pour vos cas d'utilisation.

L'ère de l'IA sur l'appareil n'est plus une promesse, mais une réalité en production. Avec la sortie de Gemini Nano v3, nous mettons des capacités de compréhension du langage et multimodales sans précédent directement entre les mains des utilisateurs. Grâce à la famille de modèles Gemini Nano, nous bénéficions d'une large couverture des appareils compatibles dans l'écosystème Android. Mais pour les développeurs qui créent la prochaine génération d'applications intelligentes, l'accès à un modèle puissant n'est que la première étape. Le véritable défi réside dans la personnalisation : comment adapter un modèle de fondation pour obtenir des performances de niveau expert pour votre cas d'utilisation spécifique sans enfreindre les contraintes du matériel mobile ?

Dans le monde côté serveur, les LLM plus volumineux ont tendance à être très performants et nécessitent moins d'adaptation au domaine. Même lorsque cela est nécessaire, des options plus avancées telles que le réglage fin LoRA (adaptation à faible rang) peuvent être des options viables. Toutefois, l'architecture unique d'Android AICore donne la priorité à un modèle système partagé et économe en mémoire. Cela signifie que le déploiement d'adaptateurs LoRA personnalisés pour chaque application individuelle pose des problèmes sur ces services système partagés.

Mais il existe une autre voie qui peut avoir un impact tout aussi important. En tirant parti de l'optimisation automatique des requêtes (APO) sur Vertex AI, les développeurs peuvent atteindre une qualité proche du réglage fin, tout en travaillant de manière transparente dans l'environnement d'exécution Android natif. En se concentrant sur des instructions système de qualité supérieure, l'APO permet aux développeurs d'adapter le comportement du modèle avec une robustesse et une évolutivité supérieures à celles des solutions de réglage fin traditionnelles.

Remarque : Gemini Nano V3 est une version optimisée en termes de qualité du modèle Gemma 3N très acclamé. Toutes les optimisations de requêtes effectuées sur le modèle Open Source Gemma 3N s'appliqueront également à Gemini Nano V3. Sur les appareils compatibles, les API GenAI de ML Kit exploitent le modèle nano-v3 pour maximiser la qualité pour les développeurs Android.

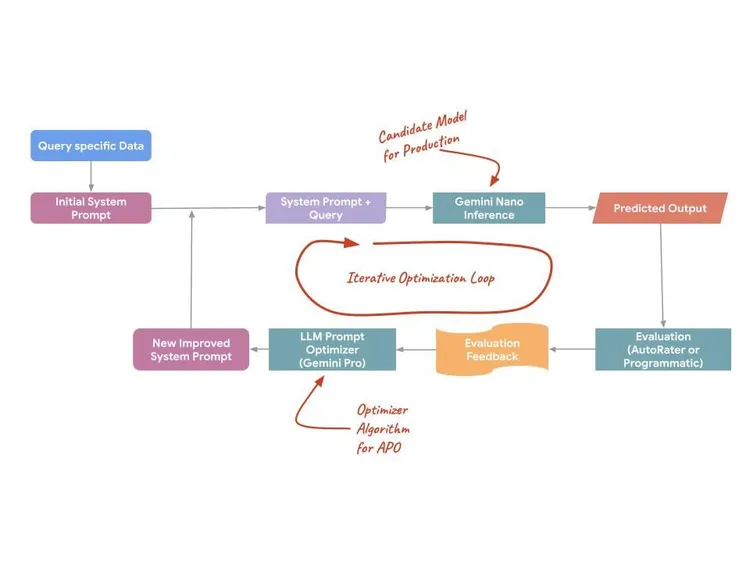

L'APO traite la requête non pas comme un texte statique, mais comme une surface programmable qui peut être optimisée. Il exploite des modèles côté serveur (tels que Gemini Pro et Flash) pour proposer des requêtes, évaluer les variations et trouver celle qui est optimale pour votre tâche spécifique. Ce processus utilise trois mécanismes techniques spécifiques pour maximiser les performances :

- Analyse automatique des erreurs : l'APO analyse les schémas d'erreur à partir des données d'entraînement pour identifier automatiquement les faiblesses spécifiques de la requête initiale.

- Distillation sémantique des instructions : elle analyse des exemples d'entraînement massifs pour distiller la "véritable intention" d'une tâche, en créant des instructions qui reflètent plus précisément la distribution réelle des données.

- Test parallèle des candidats : au lieu de tester une idée à la fois, l'APO génère et teste de nombreux candidats de requêtes en parallèle pour identifier le maximum global de qualité.

Pourquoi l'APO peut approcher la qualité du réglage fin

Il est courant de penser à tort que le réglage fin offre toujours une meilleure qualité que les requêtes. Pour les modèles de fondation modernes tels que Gemini Nano v3, l'ingénierie des requêtes peut avoir un impact en soi :

- Préservation des capacités générales : le réglage fin ( PEFT/LoRA) force les pondérations d'un modèle à sur-indexer une distribution spécifique de données. Cela entraîne souvent un "oubli catastrophique", où le modèle s'améliore dans votre syntaxe spécifique, mais se détériore en termes de logique générale et de sécurité. L'APO laisse les pondérations intactes, ce qui préserve les capacités du modèle de base.

- Suivi des instructions et découverte de stratégies : Gemini Nano v3 a été rigoureusement entraîné pour suivre des instructions système complexes. L'APO exploite cela en trouvant la structure d'instruction exacte qui débloque les capacités latentes du modèle, en découvrant souvent des stratégies qu'il peut être difficile pour les ingénieurs humains de trouver.

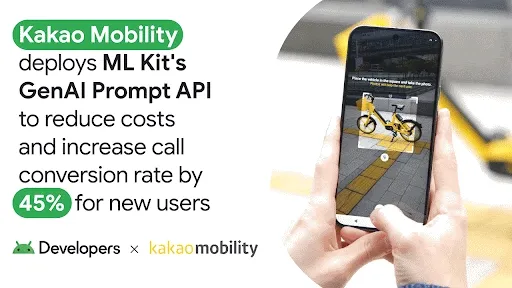

Pour valider cette approche, nous avons évalué l'APO sur diverses charges de travail de production. Notre validation a montré des gains de précision constants de 5 à 8 % dans différents cas d'utilisation.Sur plusieurs fonctionnalités déployées sur l'appareil, l'APO a permis d'améliorer considérablement la qualité.

| Cas d'utilisation | Type de tâche | Description de la tâche | Métrique | Amélioration de l'APO |

| Classification des thèmes | Classification de texte | Classer un article d'actualité dans des thèmes tels que la finance, le sport, etc. | Précision | +5% |

| Classification des intentions | Classification de texte | Classer une requête de service client en intentions | Précision | +8,0 % |

| Traduction de pages Web | Traduction de texte | Traduire une page Web de l'anglais vers une langue locale | BLEU | +8,57 % |

Un workflow de développement de bout en bout fluide

Il est courant de penser à tort que le réglage fin offre toujours une meilleure qualité que les requêtes. Pour les modèles de fondation modernes tels que Gemini Nano v3, l'ingénierie des requêtes peut avoir un impact en soi :

- Préservation des capacités générales : le réglage fin ( PEFT/LoRA) force les pondérations d'un modèle à sur-indexer une distribution spécifique de données. Cela entraîne souvent un "oubli catastrophique", où le modèle s'améliore dans votre syntaxe spécifique, mais se détériore en termes de logique générale et de sécurité. L'APO laisse les pondérations intactes, ce qui préserve les capacités du modèle de base.

- Suivi des instructions et découverte de stratégies : Gemini Nano v3 a été rigoureusement entraîné pour suivre des instructions système complexes. L'APO exploite cela en trouvant la structure d'instruction exacte qui débloque les capacités latentes du modèle, en découvrant souvent des stratégies qu'il peut être difficile pour les ingénieurs humains de trouver.

Pour valider cette approche, nous avons évalué l'APO sur diverses charges de travail de production. Notre validation a montré des gains de précision constants de 5 à 8 % dans différents cas d'utilisation.Sur plusieurs fonctionnalités déployées sur l'appareil, l'APO a permis d'améliorer considérablement la qualité.

Conclusion

La sortie de l'optimisation automatique des requêtes (APO) marque un tournant pour l'IA générative sur l'appareil. En comblant le fossé entre les modèles de fondation et les performances de niveau expert, nous fournissons aux développeurs les outils nécessaires pour créer des applications mobiles plus robustes. Que vous débutiez avec l'optimisation sans exemple ou que vous passiez à la production avec un affinement basé sur les données, la voie vers une intelligence sur l'appareil de haute qualité est désormais plus claire. Déployez vos cas d'utilisation sur l'appareil en production dès aujourd'hui avec l'API Prompt de ML Kit et l'optimisation automatique des requêtes de Vertex AI.

Liens utiles :

Lire la suite

-

Actualités sur les produits

Chez Google, nous nous engageons à mettre les modèles d'IA les plus performants directement à la disposition des appareils Android que vous avez dans votre poche. Aujourd'hui, nous sommes heureux d'annoncer la sortie de notre dernier modèle Open Source de pointe : Gemma 4.

Caren Chang, David Chou • 3 minutes de lecture

-

Actualités sur les produits

L'IA facilite la création d'expériences d'application personnalisées qui transforment le contenu au format adapté aux utilisateurs. Nous avons précédemment permis aux développeurs de s'intégrer à Gemini Nano via les API GenAI de ML Kit conçues pour des cas d'utilisation spécifiques tels que la synthèse de documents et la description d'images.

Caren Chang, Chengji Yan, Penny Li • 2 minutes de lecture

-

Actualités sur les produits

Android Studio Panda 4 est désormais stable et prêt à être utilisé en production. Cette version inclut le mode de planification, la prédiction de la prochaine modification et bien plus encore, ce qui facilite plus que jamais la création d'applications Android de haute qualité.

Matt Dyor • 5 minutes de lecture

Restez informé

Recevez chaque semaine les dernières informations sur le développement Android directement dans votre boîte de réception.