Heute erweitern wir die Gemini 3-Modellfamilie mit der Veröffentlichung von Gemini 3 Flash. Dieses Modell bietet bahnbrechende Intelligenz und Geschwindigkeit zu einem Bruchteil der Kosten.Sie können sofort damit beginnen, Apps zu entwickeln, da wir Gemini 3 Flash offiziell in Firebase AI Logic einführen.Das Modell ist weltweit verfügbar und Sie können sicher direkt über Ihre App auf die Vorschauversion von Gemini 3 Flash zugreifen. Verwenden Sie dazu die Gemini Developer API oder die Vertex AI Gemini API mit den Client-SDKs von Firebase AI Logic. Die hohe Leistung von Gemini 3 Flash in den Bereichen Schlussfolgern, Toolnutzung und multimodale Funktionen ist ideal für Entwickler, die komplexere Videoanalysen, Datenextraktionen und visuelle Fragen und Antworten durchführen möchten.

Gemini 3 für niedrige Latenz optimiert

Gemini 3 ist unsere bisher intelligenteste Modellfamilie. Mit der Einführung von Gemini 3 Flash machen wir diese Intelligenz für Anwendungsfälle mit niedriger Latenz und kostengünstiger Nutzung zugänglicher. Gemini 3 Pro wurde für komplexes Schlussfolgern entwickelt, während Gemini 3 Flash deutlich schneller und kostengünstiger für Ihre Produktions-Apps ist.

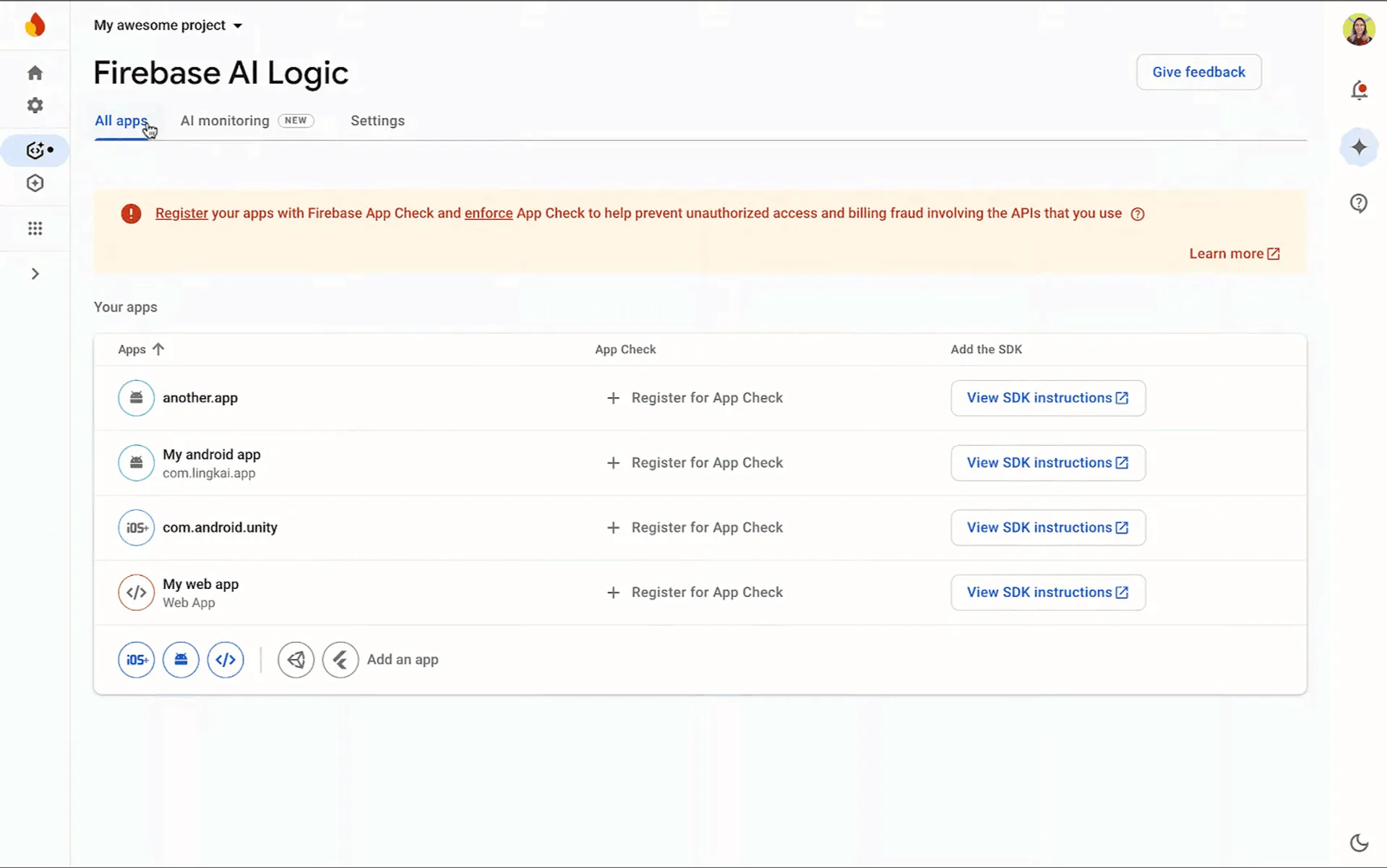

Nahtlose Integration mit Firebase AI Logic

Wie das Pro-Modell ist auch Gemini 3 Flash in der Vorschau direkt über das Firebase AI Logic SDK verfügbar. So können Sie es in Ihre Android-App einbinden, ohne komplexe serverseitige Einrichtungsschritte durchführen zu müssen.

So fügen Sie es Ihrem Kotlin-Code hinzu:

val model = Firebase.ai(backend = GenerativeBackend.googleAI()) .generativeModel(modelName = "gemini-3-flash-preview")

Zuverlässige Skalierung

Außerdem bietet Firebase Ihnen folgende Möglichkeiten, um Ihr Wachstum sicher und übersichtlich zu gestalten:

KI-Monitoring

Im Firebase KI-Monitoring-Dashboard sehen Sie Latenz, Erfolgsraten und Kosten. Sie können Daten nach Modellname aufschlüsseln, um genau zu sehen, wie das Modell funktioniert.

Server-Prompt-Vorlagen

Mit Server-Prompt-Vorlagen können Sie Ihren Prompt und Ihr Schema sicher auf Firebase-Servern speichern, anstatt sie in Ihre App-Binärdatei zu codieren. So bleiben Ihre sensiblen Prompts sicher, unbefugte Prompt-Extraktionen werden verhindert und Sie können schneller iterieren, ohne App-Updates zu benötigen.

--- model: 'gemini-3-flash-preview' input: schema: topic: type: 'string' minLength: 2 maxLength: 40 length: type: 'number' minimum: 1 maximum: 200 language: type: 'string' —-- {{role "system"}} You're a storyteller that tells nice and joyful stories with happy endings. {{role "user"}} Create a story about {{topic}} with the length of {{length}} words in the {{language}} language.

Server-Prompt-Vorlage mit der Firebase Console definiert

val generativeModel = Firebase.ai.templateGenerativeModel() val response = generativeModel.generateContent("storyteller-v10", mapOf( "topic" to topic, "length" to length, "language" to language ) ) _output.value = response.text

Code-Snippet für den Zugriff auf die Server-Prompt-Vorlage

Gemini 3 Flash für KI-Unterstützung bei der Entwicklung in Android Studio

Gemini 3 Flash ist auch für die KI-Unterstützung in Android Studio verfügbar. Während Gemini 3 Pro Preview unser bestes Modell für die Programmierung und agentenbasierte Funktionen ist, ist Gemini 3 Flash auf Geschwindigkeit ausgelegt und eignet sich hervorragend für gängige Entwicklungsaufgaben und Fragen.

Das neue Modell wird ab heute für Entwickler eingeführt, die Gemini in Android Studio kostenlos verwenden (Standardmodell). Für höhere Nutzungslimits und längere Sitzungen im Agentenmodus können Sie einen AI Studio API-Schlüssel verwenden, um die vollen Funktionen von Gemini 3 Flash oder Gemini 3 Pro zu nutzen. Außerdem führen wir den Zugriff auf die Gemini 3-Modellfamilie mit höheren Nutzungslimits für Entwickler ein, die Gemini Code Assist Standard- oder Enterprise-Lizenzen haben. Ihr IT-Administrator muss den Zugriff auf Vorschauversionen von Modellen über die Google Cloud Console aktivieren.

Jetzt loslegen

Sie können ab heute mit Gemini 3 Flash über Firebase AI Logic experimentieren. Weitere Informationen finden Sie in der Android- und Firebase-Dokumentation. Probieren Sie die neuen Gemini 3-Modelle in Android Studio aus, um Unterstützung bei der Entwicklung zu erhalten, und teilen Sie uns Ihre Meinung mit. Wie immer können Sie uns auf LinkedIn, im Blog, auf YouTube und auf X folgen.

Weiterlesen

-

Produktneuheiten

Wenn Sie Android-Entwickler sind und innovative KI-Funktionen in Ihre App implementieren möchten, haben wir vor Kurzem leistungsstarke neue Updates eingeführt.

Thomas Ezan • 3 Minuten Lesezeit

-

Produktneuheiten

Wenn Sie Ihrer App benutzerdefinierte Bilder hinzufügen, können Sie die Nutzerfreundlichkeit deutlich verbessern und personalisieren und die Nutzerinteraktion steigern.

Thomas Ezan, Mozart Louis • 5 Minuten Lesezeit

-

Produktneuheiten

Android Studio Panda 4 ist jetzt stabil und kann für die Produktion verwendet werden. Diese Version bietet unter anderem den Planungsmodus und die Vorhersage der nächsten Bearbeitung, mit denen Sie hochwertige Android-Apps einfacher als je zuvor entwickeln können.

Matt Dyor • 5 Minuten Lesezeit

Auf dem Laufenden bleiben

Lassen Sie sich Woche für Woche die neuesten Informationen zur Android-Entwicklung zusenden.