Produktneuheiten

Experimentelle hybride Inferenz und neue Gemini-Modelle für Android

3 Minuten Lesezeit

Wenn Sie als Android-Entwickler innovative KI-Funktionen in Ihre App implementieren möchten, haben wir vor Kurzem leistungsstarke neue Updates veröffentlicht:

- Hybride Inferenz, eine neue API für Firebase AI Logic, mit der sowohl die Inferenz auf dem Gerät als auch in der Cloud genutzt werden kann,

- Unterstützung für neue Gemini-Modelle, einschließlich der neuesten Nano Banana-Modelle für die Bildgenerierung.

Fangen wir am besten gleich an.

Hybride Inferenz testen

Mit der neuen Firebase API für hybride Inferenz haben wir einen einfachen regelbasierten Routingansatz als erste Lösung implementiert, mit der Sie sowohl die Inferenz auf dem Gerät als auch in der Cloud über eine einheitliche API nutzen können. Wir planen, in Zukunft komplexere Routingfunktionen anzubieten.

So kann Ihre App dynamisch zwischen Gemini Nano, das lokal auf dem Gerät ausgeführt wird, und in der Cloud gehosteten Gemini-Modellen wechseln. Bei der Ausführung auf dem Gerät wird die Prompt API von ML Kit verwendet. Die Cloud-Inferenz unterstützt alle Gemini-Modelle von Firebase AI Logic in Vertex AI und der Developer API.

Fügen Sie dazu die firebase-ai-ondevice Abhängigkeiten zusammen mit Firebase AI Logic zu Ihrer App hinzu:

dependencies { [...] implementation("com.google.firebase:firebase-ai:17.10.1") implementation("com.google.firebase:firebase-ai-ondevice:16.0.0-beta01") }

Bei der Initialisierung erstellen Sie eine GenerativeModel-Instanz und konfigurieren sie mit bestimmten Inferenzmodi wie PREFER_ON_DEVICE (fällt auf die Cloud zurück, wenn Gemini Nano auf dem Gerät nicht verfügbar ist) oder PREFER_IN_CLOUD (fällt auf die Inferenz auf dem Gerät zurück, wenn keine Internetverbindung besteht):

val model = Firebase.ai(backend = GenerativeBackend.googleAI()) .generativeModel( modelName = "gemini-3.1-flash-lite", onDeviceConfig = OnDeviceConfig( mode = InferenceMode.PREFER_ON_DEVICE ) ) val response = model.generateContent(prompt)

Die Firebase API für hybride Inferenz für Android ist noch experimentell. Wir empfehlen Ihnen, sie in Ihrer App auszuprobieren, insbesondere wenn Sie bereits Firebase AI Logic verwenden.

Derzeit sind Modelle auf dem Gerät auf die einmalige Textgenerierung auf Grundlage von Text- oder Bitmap-Bild-Eingaben spezialisiert. Weitere Informationen finden Sie unter Einschränkungen.

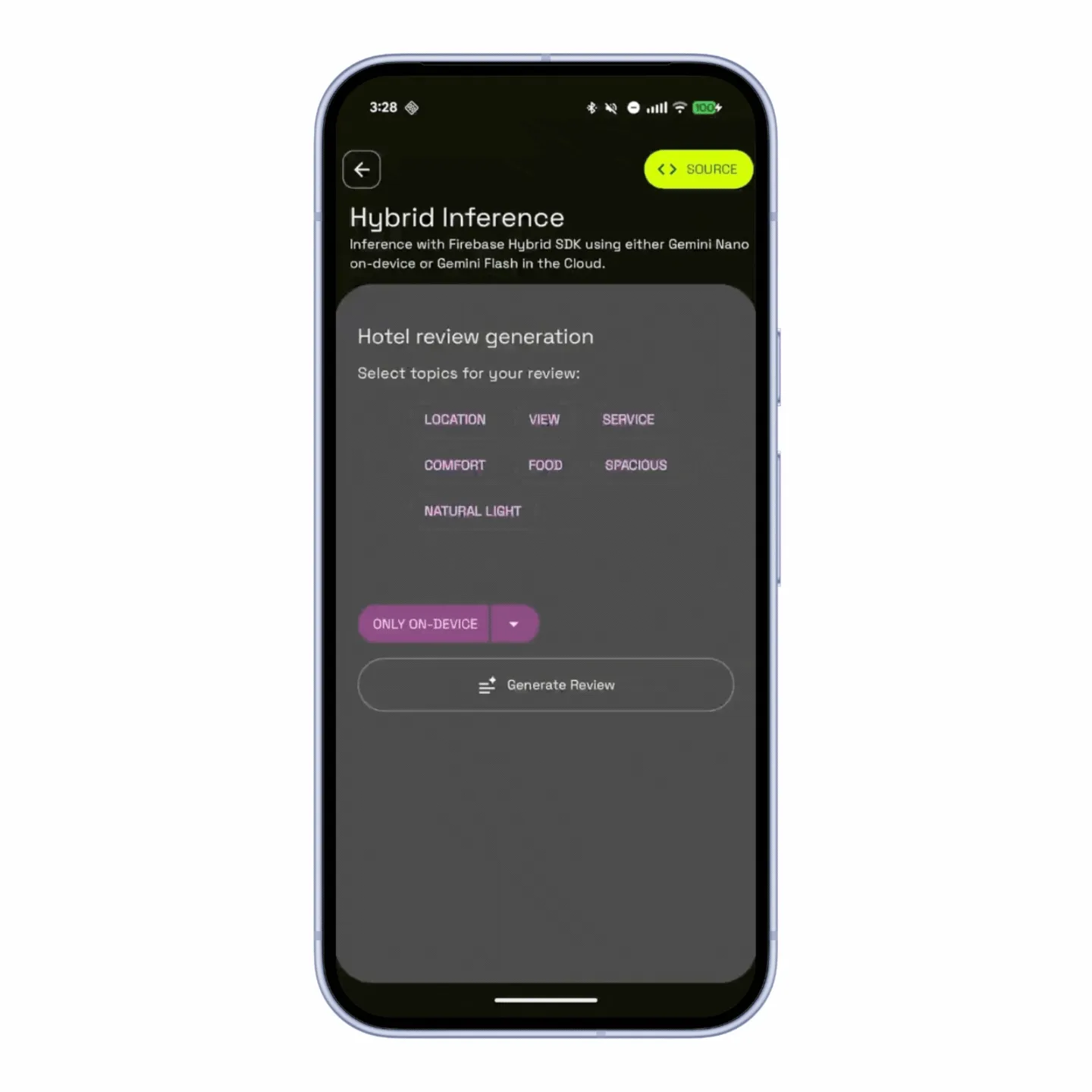

Wir haben gerade ein neues Beispiel im AI Sample Catalog veröffentlicht, das die Firebase API für hybride Inferenz nutzt. Es zeigt, wie die Firebase API für hybride Inferenz verwendet werden kann, um eine Rezension auf Grundlage einiger ausgewählter Themen zu generieren und sie dann in verschiedene Sprachen zu übersetzen. Sehen Sie sich den Code an, um die Funktion in Aktion zu sehen.

Das neue Beispiel für hybride Inferenz in Aktion

Neue Modelle testen

Im Rahmen der neuen Gemini-Modelle haben wir zwei Modelle veröffentlicht, die für Android-Entwickler besonders hilfreich sind und über das Firebase AI Logic SDK einfach in Ihre Anwendung eingebunden werden können.

Nano Banana

Letztes Jahr haben wir Nano Banana veröffentlicht, ein hochmodernes Modell für die Bildgenerierung. Vor einigen Wochen haben wir einige neue Nano Banana-Modelle veröffentlicht.

Nano Banana Pro (Gemini 3 Pro Image) wurde für die professionelle Asset-Produktion entwickelt und kann Text in hoher Qualität rendern, auch in einer bestimmten Schriftart oder durch Simulation verschiedener Arten von Handschrift.

_Nano Banana 2 (Gemini 3.1 Flash Image)_ ist das hocheffiziente Gegenstück zu Nano Banana Pro. Es ist für Geschwindigkeit und Anwendungsfälle mit hohem Volumen optimiert. Es kann für eine Vielzahl von Anwendungsfällen verwendet werden (Infografiken, virtuelle Sticker, kontextbezogene Illustrationen usw.).

Die neuen Nano Banana-Modelle nutzen Wissen aus der realen Welt und umfassende Schlussfolgerungsfunktionen, um präzise und detaillierte Bilder zu generieren.

Wir haben unser Magic Selfie-Beispiel aktualisiert (mit der Bildgenerierung den Hintergrund Ihres Selfies ändern), um Nano Banana 2 zu verwenden. Die Hintergrundsegmentierung wird jetzt direkt mit dem Bildgenerierungsmodell verarbeitet, was die Implementierung erleichtert und die verbesserten Bildgenerierungsfunktionen von Nano Banana 2 zur Geltung bringt. Hier können Sie sich die Funktion in Aktion ansehen hier.

Sie können es über das Firebase AI Logic SDK verwenden. Weitere Informationen finden Sie in der Android-Dokumentation.

Gemini 3.1 Flash-Lite

Wir haben auch Gemini 3.1 Flash-Lite veröffentlicht, eine neue Version der Gemini Flash-Lite-Familie. Die Gemini Flash-Lite-Modelle sind bei Android-Entwicklern besonders beliebt, da sie ein gutes Verhältnis zwischen Qualität und Latenz sowie niedrige Inferenzkosten bieten. Sie werden von Android-Entwicklern für verschiedene Anwendungsfälle verwendet, z. B. für die Übersetzung von In-App-Nachrichten oder die Generierung eines Rezepts aus einem Bild eines Gerichts.

Gemini 3.1 Flash-Lite, das sich derzeit in der Vorschau befindet, ermöglicht erweiterte Anwendungsfälle mit einer Latenz, die mit Gemini 2.5 Flash-Lite vergleichbar ist.

Weitere Informationen zu diesem Modell finden Sie in der Firebase-Dokumentation.

Schlusswort

Es ist ein guter Zeitpunkt, das neue Hybrid-Beispiel in unserem Katalog zu testen, um diese Funktionen in Aktion zu sehen und die Vorteile des Routings zwischen Inferenz auf dem Gerät und in der Cloud zu verstehen. Wir empfehlen Ihnen außerdem, sich unsere Dokumentation anzusehen, um die neuen Gemini-Modelle zu testen.

Weiterlesen

-

Produktneuheiten

Heute erweitern wir die Gemini 3-Modellfamilie mit der Veröffentlichung von Gemini 3 Flash, einer bahnbrechenden KI, die für Geschwindigkeit entwickelt wurde und nur einen Bruchteil der Kosten verursacht.

Thomas Ezan • 2 Minuten Lesezeit

-

Produktneuheiten

Wenn Sie Ihrer App benutzerdefinierte Bilder hinzufügen, können Sie die Nutzerfreundlichkeit deutlich verbessern und personalisieren und die Nutzerinteraktion steigern.

Thomas Ezan, Mozart Louis • 5 Minuten Lesezeit

-

Produktneuheiten

Android Studio Panda 4 ist jetzt stabil und kann für die Produktion verwendet werden. Diese Version bietet den Planungsmodus, die Vorhersage der nächsten Bearbeitung und vieles mehr, sodass es einfacher als je zuvor ist, hochwertige Android-Apps zu entwickeln.

Matt Dyor • 5 Minuten Lesezeit

Auf dem Laufenden bleiben

Lassen Sie sich Woche für Woche die neuesten Informationen zur Android-Entwicklung zusenden.