Produktneuheiten

KI-gestützte Android-Entwicklung verbessern und LLMs mit Android Bench optimieren

2 Minuten Lesezeit

Wir möchten Ihnen die Entwicklung hochwertiger Android-Apps erleichtern und beschleunigen. Dazu stellen wir Ihnen KI-Funktionen zur Verfügung, mit denen Sie produktiver arbeiten können. Wir wissen, dass Sie KI-Funktionen benötigen, die die Nuancen der Android-Plattform wirklich verstehen. Deshalb haben wir gemessen, wie gut LLMs bei Android-Entwicklungsaufgaben abschneiden. Heute haben wir die erste Version von Android Bench veröffentlicht, unserer offiziellen Rangliste von LLMs für die Android-Entwicklung.

Unser Ziel ist es, Modellentwicklern einen Benchmark zur Verfügung zu stellen, mit dem sie die LLM-Funktionen für die Android-Entwicklung bewerten können. Durch die Festlegung einer klaren, zuverlässigen Grundlage für eine hochwertige Android-Entwicklung können Modellentwickler Lücken erkennen und Verbesserungen beschleunigen. So können Entwickler effizienter arbeiten und aus einer größeren Auswahl an hilfreichen Modellen für die KI-Unterstützung wählen. Das führt letztendlich zu hochwertigeren Apps im gesamten Android-Ökosystem.

Entwickelt mit Android-Entwicklungsaufgaben aus der Praxis

Wir haben den Benchmark erstellt, indem wir eine Reihe von Aufgaben aus verschiedenen Bereichen der Android-Entwicklung zusammengestellt haben. Er besteht aus realen Herausforderungen mit unterschiedlichem Schwierigkeitsgrad, die aus öffentlichen GitHub-Android-Repositories stammen. Zu den Szenarien gehören beispielsweise das Beheben von Breaking Changes in verschiedenen Android-Versionen, domänenspezifische Aufgaben wie die Vernetzung auf Wearables und die Migration zur neuesten Version von Jetpack Compose.

Bei jeder Bewertung muss ein LLM das in der Aufgabe gemeldete Problem beheben. Wir überprüfen das dann mit Unit- oder Instrumentierungstests. Dieser modellunabhängige Ansatz ermöglicht es uns, die Fähigkeit eines Modells zu messen, sich in komplexen Codebases zurechtzufinden, Abhängigkeiten zu verstehen und die Art von Problemen zu lösen, die Ihnen täglich begegnen.

Wir haben diese Methodik mit mehreren LLM-Entwicklern validiert, darunter JetBrains.

„Die Auswirkungen von KI auf Android zu messen, ist eine große Herausforderung. Deshalb ist es toll, ein so fundiertes und realistisches Framework zu sehen. Wir führen zwar selbst Benchmarks durch, aber Android Bench ist eine einzigartige und willkommene Ergänzung. Diese Methodik ist genau die Art von rigoroser Bewertung, die Android-Entwickler derzeit benötigen.“

- Kirill Smelov, Head of AI Integrations bei JetBrains.

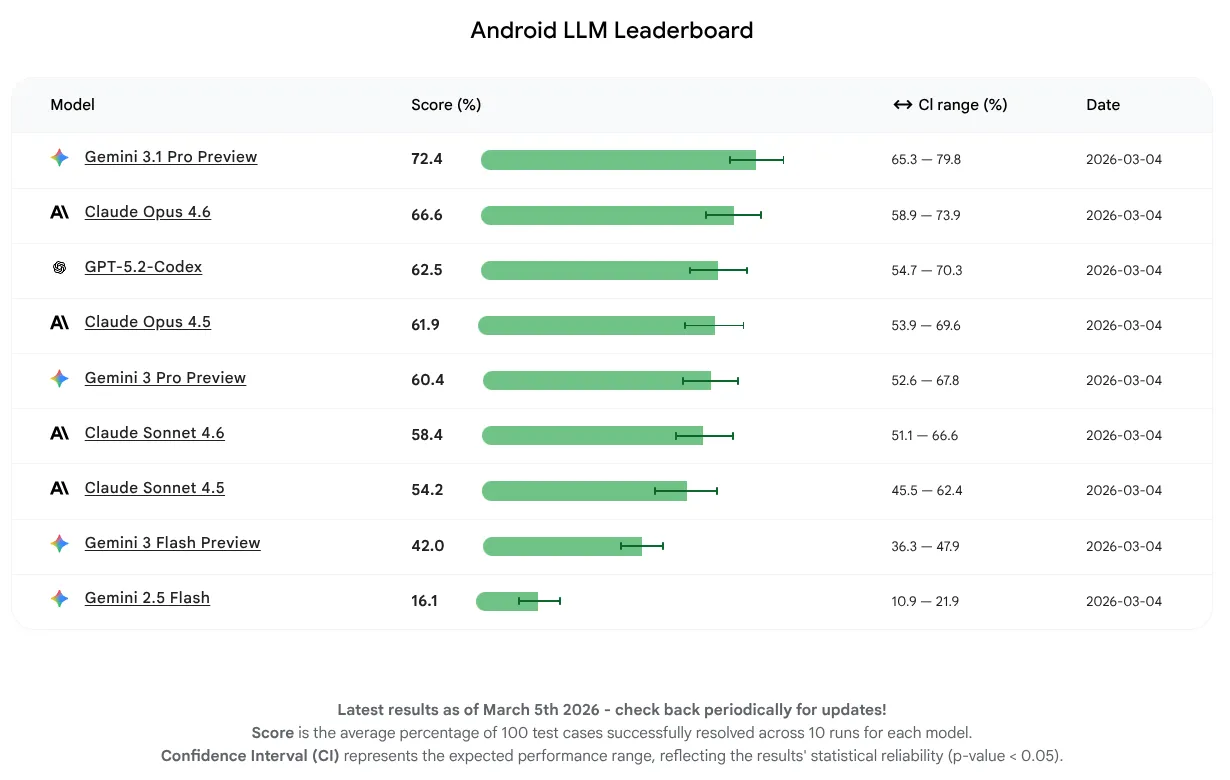

Die ersten Android Bench-Ergebnisse

Bei dieser ersten Version wollten wir ausschließlich die Modellleistung messen und uns nicht auf die Nutzung von Agenten oder Tools konzentrieren. Die Modelle konnten 16 bis 72% der Aufgaben erfolgreich abschließen. Diese große Bandbreite zeigt, dass einige LLMs bereits eine starke Grundlage für Android-Wissen haben, während andere noch Verbesserungspotenzial haben. Unabhängig davon, wo die Modelle derzeit stehen, erwarten wir weitere Verbesserungen, da wir LLM-Entwickler dazu anregen, ihre Modelle für die Android-Entwicklung zu optimieren.

Das LLM mit der höchsten durchschnittlichen Punktzahl für diese erste Version ist Gemini 3.1 Pro, gefolgt von Claude Opus 4.6. Sie können alle von uns bewerteten Modelle für die KI-Unterstützung für Ihre Android-Projekte testen, indem Sie API-Schlüssel in der neuesten stabilen Version von Android Studio verwenden.

Transparenz für Entwickler und LLM-Entwickler

Wir legen Wert auf einen offenen und transparenten Ansatz. Deshalb haben wir unsere Methodik, unser Dataset und unsere Testumgebung auf GitHub öffentlich zugänglich gemacht.

Eine Herausforderung bei jedem öffentlichen Benchmark ist das Risiko einer Datenkontamination, bei der Modelle während des Trainings möglicherweise Bewertungsaufgaben gesehen haben. Wir haben Maßnahmen ergriffen, um sicherzustellen, dass unsere Ergebnisse auf echtem logischen Denken beruhen und nicht auf Auswendiglernen oder Raten. Dazu gehören eine gründliche manuelle Überprüfung der Agententrajektorien und die Einbindung eines Canary-Strings, um das Training zu verhindern.

Wir werden unsere Methodik weiterentwickeln, um die Integrität des Datasets zu wahren und gleichzeitig Verbesserungen für zukünftige Versionen des Benchmarks vorzunehmen. Dazu gehört beispielsweise die Erhöhung der Anzahl und Komplexität der Aufgaben.

Wir sind gespannt, wie Android Bench die KI-Unterstützung langfristig verbessern kann. Unsere Vision ist es, die Lücke zwischen Konzept und hochwertigem Code zu schließen. Wir legen den Grundstein für eine Zukunft, in der Sie alles, was Sie sich vorstellen, auf Android entwickeln können.

Weiterlesen

-

Produktneuheiten

Heute verbessern wir die Android-Entwicklung mit Gemma 4, unserem neuesten hochmodernen offenen Modell mit komplexen logischen Denkfähigkeiten und autonomen Tool-Aufruffunktionen.

Matthew McCullough • 2 Minuten Lesezeit

-

Produktneuheiten

Mit der Betaversion 3 hat Android 17 heute offiziell die Plattformstabilität erreicht. Das bedeutet, dass die API-Oberfläche gesperrt ist. Sie können die endgültigen Kompatibilitätstests durchführen und Ihre für Android 17 entwickelten Apps im Play Store veröffentlichen.

Matthew McCullough • 5 Minuten Lesezeit

-

Produktneuheiten

Heute veröffentlichen wir die zweite Betaversion von Android 17. Wir arbeiten weiter daran, eine Plattform zu entwickeln, bei der Datenschutz, Sicherheit und verbesserte Leistung im Vordergrund stehen.

Matthew McCullough • 6 Minuten Lesezeit

Auf dem Laufenden bleiben

Lassen Sie sich Woche für Woche die neuesten Informationen zur Android-Entwicklung zusenden.