Wiadomości o usługach

Ulepszanie programowania aplikacji na Androida wspomaganego przez AI i modeli LLM za pomocą Android Bench

Czas czytania: 2 min

Chcemy, aby tworzenie wysokiej jakości aplikacji na Androida było szybsze i łatwiejsze. Jednym ze sposobów na zwiększenie Twojej produktywności jest udostępnienie Ci AI. Wiemy, że zależy Ci na AI, która naprawdę rozumie niuanse platformy Android. Dlatego sprawdzamy, jak duże modele językowe radzą sobie z zadaniami związanymi z programowaniem na Androida. Dziś udostępniliśmy pierwszą wersję Android Bench, naszej oficjalnej tabeli wyników modeli LLM do tworzenia aplikacji na Androida.

Naszym celem jest udostępnienie twórcom modeli testu porównawczego, który pozwoli ocenić możliwości LLM w zakresie programowania na Androida. Ustalając jasne i wiarygodne podstawy tego, jak powinna wyglądać wysokiej jakości aplikacja na Androida, pomagamy twórcom modeli identyfikować luki i przyspieszać wprowadzanie ulepszeń. Dzięki temu deweloperzy mogą wydajniej pracować z szerszą gamą przydatnych modeli, które mogą wykorzystywać do uzyskiwania pomocy opartej na AI. W efekcie w ekosystemie Androida pojawią się aplikacje o wyższej jakości.

Zaprojektowane z myślą o rzeczywistych zadaniach związanych z tworzeniem aplikacji na Androida

Utworzyliśmy test porównawczy, wybierając zestaw zadań z różnych obszarów typowych dla tworzenia aplikacji na Androida. Składa się z prawdziwych wyzwań o różnym stopniu trudności, pochodzących z publicznych repozytoriów Androida na GitHubie. Obejmują one m.in. rozwiązywanie problemów ze zmianami powodującymi niezgodność w różnych wersjach Androida, wykonywanie zadań związanych z określonymi domenami, takich jak obsługa sieci na urządzeniach do noszenia, oraz migrację do najnowszej wersji Jetpack Compose.

W ramach każdej oceny model LLM próbuje rozwiązać problem zgłoszony w zadaniu, a my weryfikujemy to za pomocą testów jednostkowych lub testów instrumentacyjnych. To podejście niezależne od modelu pozwala nam mierzyć jego zdolność do poruszania się po złożonych bazach kodu, rozumienia zależności i rozwiązywania problemów, z którymi spotykasz się na co dzień.

Potwierdziliśmy tę metodologię z kilkoma twórcami LLM, w tym z firmą JetBrains.

„Pomiar wpływu AI na Androida to ogromne wyzwanie, dlatego cieszę się, że powstały tak solidne i realistyczne ramy. Chociaż sami aktywnie przeprowadzamy testy porównawcze, Android Bench jest wyjątkowym i mile widzianym dodatkiem. Ta metodologia to dokładnie ten rodzaj rygorystycznej oceny, jakiego potrzebują obecnie programiści Androida”.

– Kirill Smelov, szef integracji AI w JetBrains

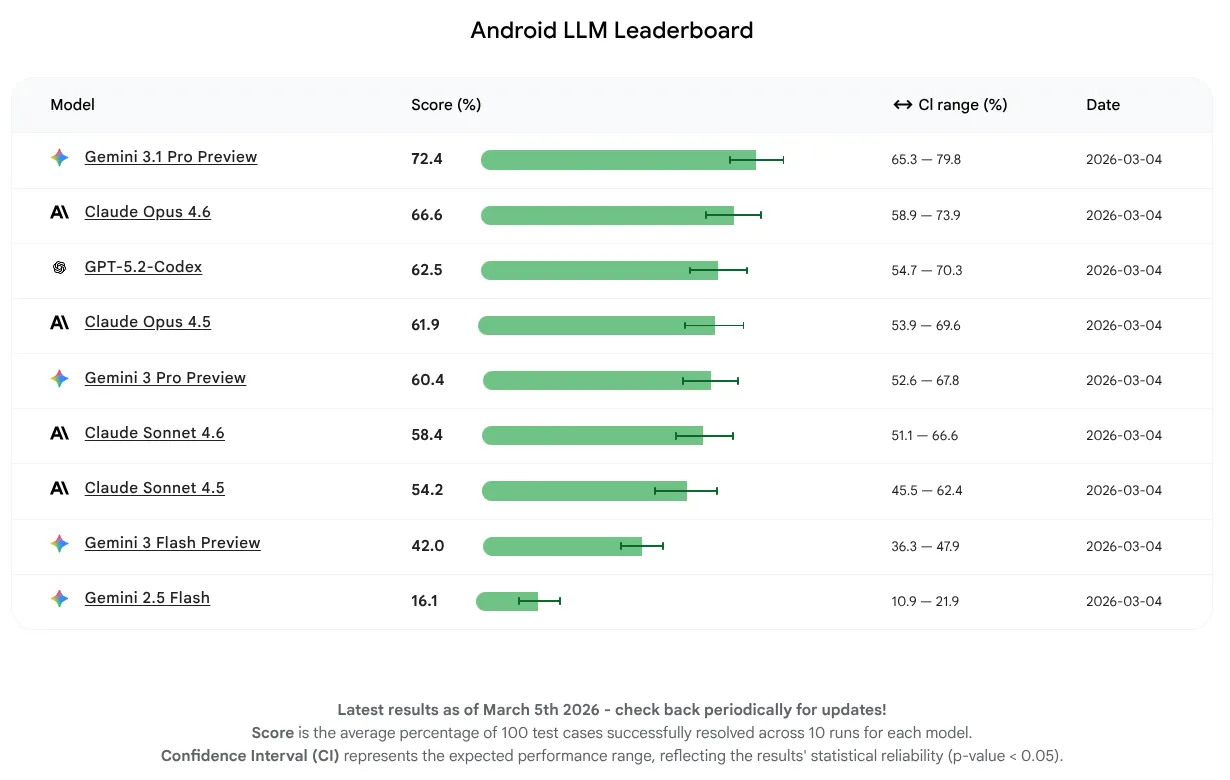

Pierwsze wyniki Android Bench

W tej pierwszej wersji chcieliśmy mierzyć wyłącznie skuteczność modelu, a nie skupiać się na korzystaniu z agentów ani narzędzi. Modele zdołały wykonać 16–72% zadań. To szeroki zakres, który pokazuje, że niektóre duże modele językowe mają już solidne podstawy wiedzy o Androidzie, a inne mają większe możliwości rozwoju. Niezależnie od tego, na jakim etapie rozwoju są obecnie modele, spodziewamy się dalszego postępu, ponieważ zachęcamy twórców LLM do ulepszania swoich modeli pod kątem tworzenia aplikacji na Androida.

Model LLM z najwyższym średnim wynikiem w tej pierwszej wersji to Gemini 3.1 Pro, a za nim plasuje się Claude Opus 4.6. Możesz wypróbować wszystkie modele, które oceniliśmy pod kątem pomocy AI w projektach na Androida, używając kluczy interfejsu API w najnowszej stabilnej wersji Androida Studio.

Zapewnianie przejrzystości deweloperom i twórcom LLM

Cenimy sobie otwarte i przejrzyste podejście, dlatego udostępniliśmy naszą metodologię, zbiór danych i platformę testową publicznie w GitHubie.

Jednym z wyzwań związanych z dowolnym publicznym testem porównawczym jest ryzyko zanieczyszczenia danych, czyli sytuacja, w której modele mogły mieć kontakt z zadaniami ewaluacyjnymi podczas procesu trenowania. Podjęliśmy środki, aby nasze wyniki odzwierciedlały prawdziwe rozumowanie, a nie zapamiętywanie czy zgadywanie. Obejmują one dokładną ręczną weryfikację trajektorii agenta lub integrację ciągu kanarkowego, aby zniechęcić do trenowania.

W przyszłości będziemy nadal rozwijać naszą metodologię, aby zachować integralność zbioru danych, a także wprowadzać ulepszenia w kolejnych wersjach testu porównawczego, np. zwiększać liczbę i złożoność zadań.

Z niecierpliwością czekamy na to, jak Android Bench może długoterminowo ulepszyć wspomaganie przez AI. Naszym celem jest zmniejszenie dystansu między koncepcją a kodem wysokiej jakości. Tworzymy podstawy przyszłości, w której wszystko, co sobie wyobrazisz, będziesz w stanie stworzyć na Androidzie.

Czytaj dalej

-

Wiadomości o usługach

Dziś rozszerzamy możliwości programowania na Androida dzięki Gemmie 4, naszemu najnowszemu, zaawansowanemu modelowi otwartemu, który został zaprojektowany z myślą o złożonym rozumowaniu i autonomicznym wywoływaniu narzędzi.

Matthew McCullough • Czas czytania: 2 minuty

-

Wiadomości o usługach

Wersja beta 3 Androida 17 osiągnęła dziś oficjalnie stabilność platformy. Oznacza to, że interfejs API jest zablokowany. Możesz przeprowadzić ostateczne testy zgodności i przesłać do Sklepu Play aplikacje przeznaczone na Androida 17.

Matthew McCullough • Czas czytania: 5 minut

-

Wiadomości o usługach

Dziś udostępniamy drugą wersję beta Androida 17, kontynuując prace nad platformą, która stawia na pierwszym miejscu prywatność, bezpieczeństwo i wydajność.

Matthew McCullough • Czas czytania: 6 minut

Bądź na bieżąco

Otrzymuj co tydzień najnowsze informacje o tworzeniu aplikacji na Androida na swoją skrzynkę odbiorczą.