我们希望让您能够更快、更轻松地构建高品质 Android 应用,而帮助您提高工作效率的一种方式就是让您随时随地都能使用 AI。我们知道,您需要真正了解 Android 平台细微差别的 AI,因此我们一直在衡量 LLM 在执行 Android 开发任务时的表现。今天,我们发布了首个版本的 Android Bench,这是我们官方的面向 Android 开发的 LLM 排行榜。

我们的目标是为模型创建者提供一个基准,以评估 LLM 在 Android 开发方面的能力。通过为高质量的 Android 开发建立清晰可靠的基准,我们可帮助模型创建者发现差距并加快改进速度,从而让开发者能够更高效地工作,并有更多实用模型可供选择,以获取 AI 辅助功能,最终在整个 Android 生态系统中打造出更高质量的应用。

以实际 Android 开发任务为基础设计

我们通过精心挑选一系列针对常见 Android 开发领域的任务来创建基准。它由难度各异的真实挑战组成,这些挑战来自公开的 GitHub Android 代码库。应用场景包括解决各个 Android 版本之间的重大变更、特定于网域的任务(例如穿戴式设备上的联网)以及迁移到最新版本的 Jetpack Compose 等。

每次评估都会尝试让 LLM 修复任务中报告的问题,然后我们使用单元测试或插桩测试来验证修复情况。这种不限模型的方法使我们能够衡量模型在以下方面的能力:浏览复杂的代码库、了解依赖关系,以及解决您每天遇到的各种问题。

我们已与多家 LLM 制造商(包括 JetBrains)验证了此方法。

“衡量 AI 对 Android 的影响是一项巨大的挑战,因此很高兴看到如此健全且切合实际的框架。虽然我们一直在积极进行基准比较,但 Android Bench 的推出无疑是一项独特而受欢迎的举措。这种方法正是 Android 开发者目前需要的严谨评估方法。”

- Kirill Smelov,JetBrains AI 集成主管。

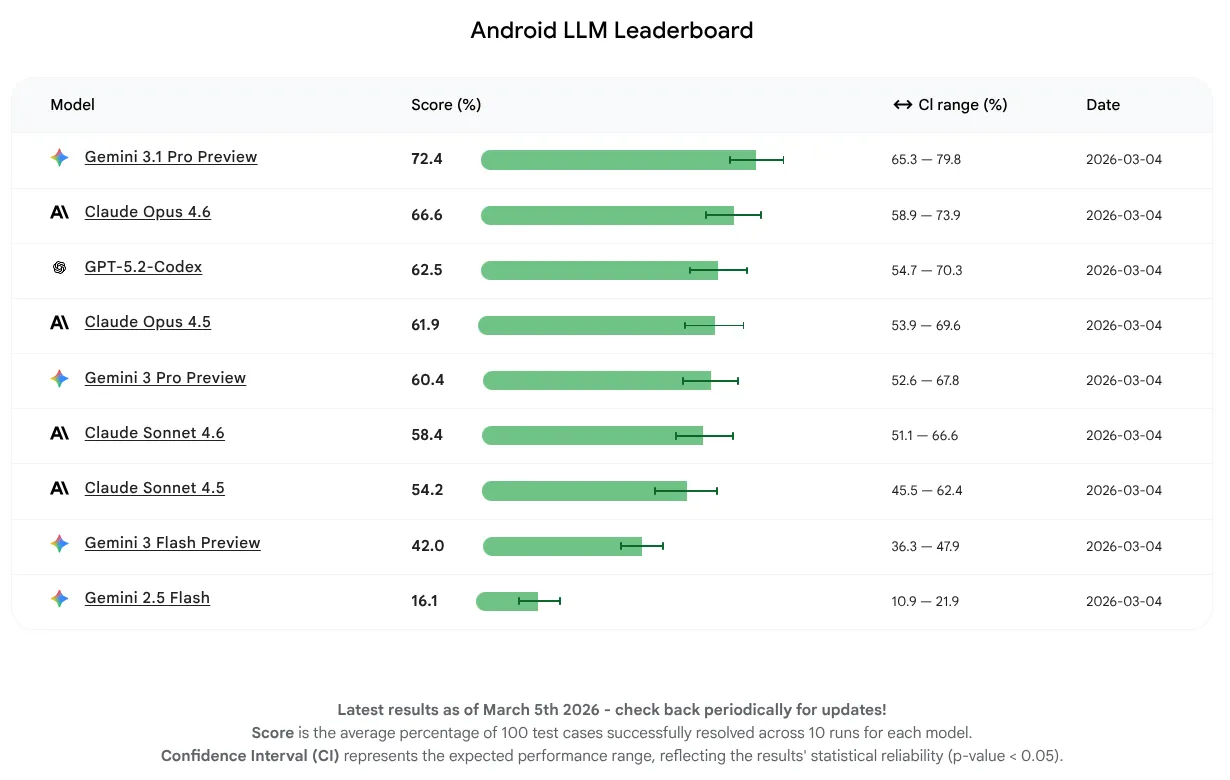

首个 Android Bench 结果

对于此初始版本,我们希望纯粹衡量模型性能,而不关注智能体或工具使用情况。这些模型能够成功完成 16-72% 的任务。这一范围很广,表明部分 LLM 在 Android 知识方面已经具备很强的基准,而其他 LLM 还有很大的改进空间。无论模型目前处于何种水平,我们都期待它们能不断改进,因为我们鼓励大语言模型制造商针对 Android 开发增强其模型。

在首个版本中,平均得分最高的 LLM 是 Gemini 3.1 Pro,紧随其后的是 Claude Opus 4.6。您可以在最新稳定版 Android Studio 中使用 API 密钥,尝试我们评估过的所有可为 Android 项目提供 AI 辅助功能的模型。

为开发者和 LLM 制造者提供透明度

我们重视公开透明的方法,因此将我们的方法、数据集和测试框架在 GitHub 上公开提供。

任何公开基准都面临数据污染的风险,即模型可能在训练过程中遇到过评估任务。我们已采取措施来确保结果反映的是真实的推理,而不是记忆或猜测,包括对智能体轨迹进行全面的人工审核,或集成 Canary 字符串来阻止训练。

展望未来,我们将继续改进我们的方法,以保持数据集的完整性,同时为基准的未来版本做出改进,例如增加任务的数量和复杂性。

我们期待 Android Bench 在未来如何改进 AI 助理。我们的愿景是弥合概念与优质代码之间的差距。我们正在为未来奠定基础,让您无论想象出什么,都能在 Android 上实现。

继续阅读

-

产品资讯

Google I/O '26 大会发布了 17 项针对 Android 开发者的重要公告,重点介绍了以代理为主导的生产力、作为界面标准的 Compose First,以及适用于不断扩展的生态系统的高性能媒体和自适应开发。

Matthew McCullough • 阅读用时:8 分钟

-

产品资讯

在今天的 Android Show 上,我们宣布 Android 将从操作系统转型为智能系统,从而为用户与您的应用互动创造更多机会。

Matthew McCullough • 阅读用时:4 分钟

-

产品资讯

今天,我们推出了 Gemma 4,这款最新的尖端开放模型具备复杂的推理和自主工具调用功能,可助力开发者提升 Android 开发效率。

Matthew McCullough • 阅读用时:2 分钟

随时了解最新动态

每周通过电子邮件接收最新的 Android 开发洞见。