Gemini Nano を使用すると、ネットワーク接続やクラウドへのデータの送信を必要とせずに、豊富な生成 AI エクスペリエンスを提供できます。オンデバイス AI は、低コストとプライバシー保護が主な懸念事項であるユースケースに最適なソリューションです。

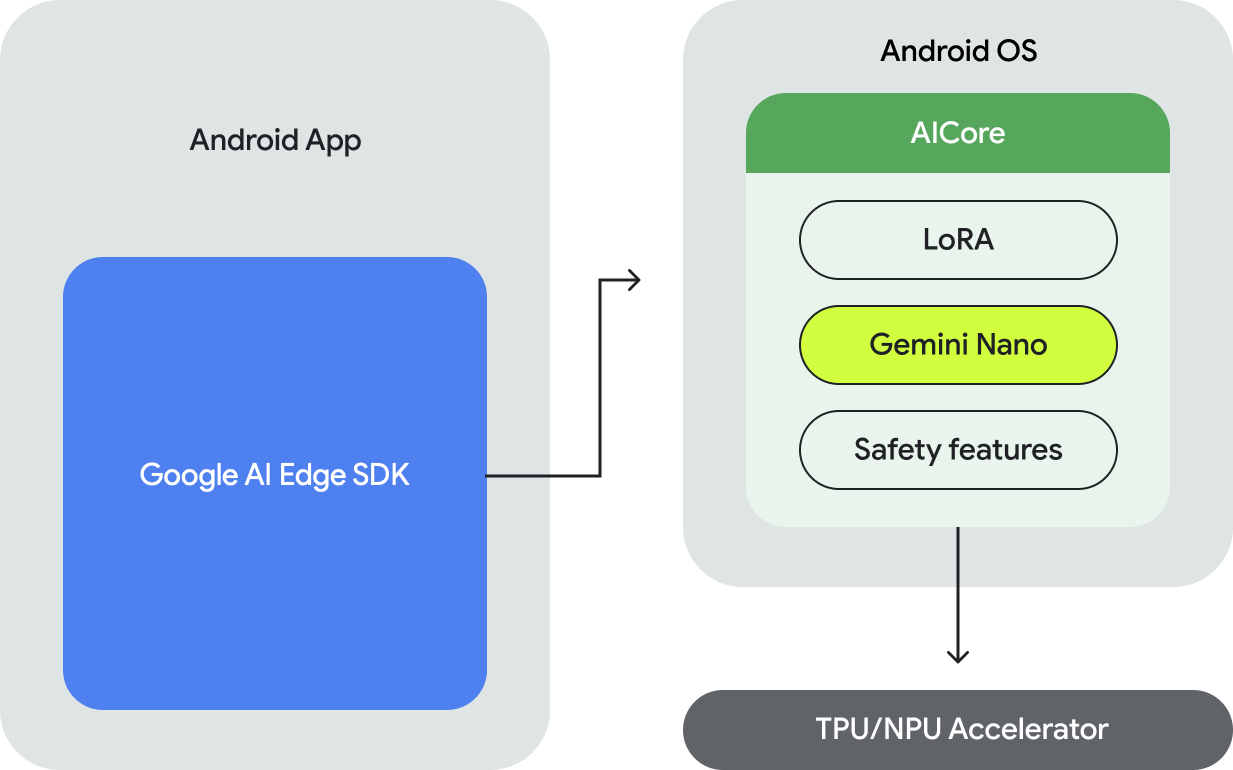

デバイス上のユースケースでは、Google の Gemini Nano 基盤モデルを活用できます。Gemini Nano は Android の AICore システム サービスで実行されます。このサービスは、デバイスのハードウェアを活用して推論のレイテンシを低く抑え、モデルを最新の状態に保ちます。

ML Kit GenAI API

ML Kit の GenAI API は Gemini Nano の能力を活用して、アプリがタスクを実行できるようにします。これらの API は、高レベルのインターフェースを通じて、一般的なユースケースにすぐに使用できる品質を提供します。ML Kit GenAI API は AICore をベースに構築されています。AICore は、生成 AI 基盤モデルのオンデバイス実行を可能にする Android システム サービスで、データをローカルで処理することで、アプリの機能強化やユーザーのプライバシーの向上などの機能を実現します。詳細

主な特長

ML Kit GenAI API は、次の機能をサポートしています。

- プロンプト: カスタムのテキストのみのプロンプトまたはマルチモーダル プロンプトに基づいてテキスト コンテンツを生成します。

- 要約: 記事や会話を箇条書きで要約します。

- 校正: 短いチャット メッセージを校正します。

- 書き換え: 短いチャット メッセージをさまざまなトーンやスタイルで書き換えます。

- 画像の説明: 指定された画像の簡単な説明を生成します。

- 音声認識: 音声をテキストに変換します。

AICore を介したアーキテクチャ

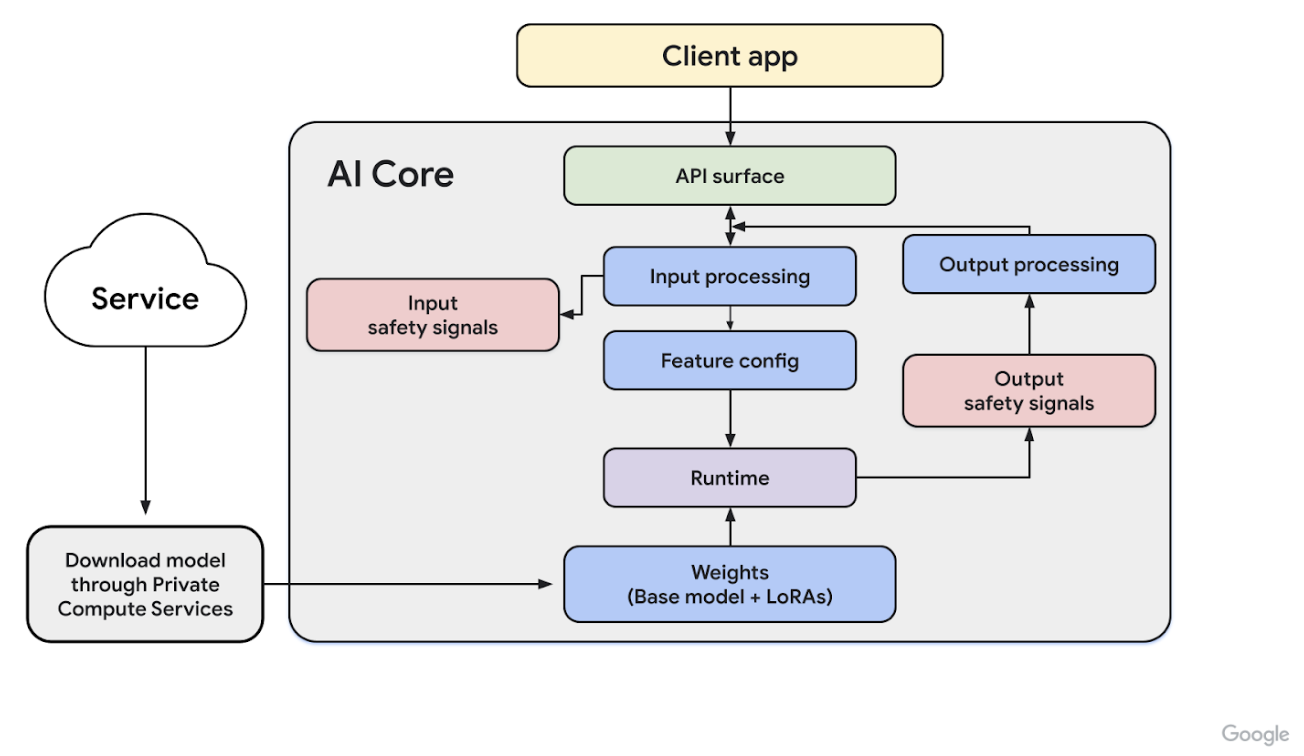

システムレベルのモジュールとして、一連の API を介して AICore にアクセスし、デバイス上で推論を実行します。また、AICore にはいくつかの安全機能が組み込まれており、安全フィルタに対する徹底的な評価が保証されています。次の図は、アプリが AICore にアクセスして Gemini Nano をオンデバイスで実行する仕組みの概要を示しています。

ユーザーデータをプライベートかつ安全に保持する

オンデバイスの生成 AI はプロンプトをローカルで実行するため、サーバー呼び出しが不要になります。これによりネットワーク レイテンシは解消されますが、推論速度はデバイスのハードウェアに依存します。このアプローチでは、センシティブ データをデバイス上に保持することでプライバシーを強化し、オフライン機能を有効にして、推論コストを削減します。

AICore は Private Compute Core の原則に準拠しており、次の主な特徴があります。

- 制限付きパッケージ バインディング: AICore は、ほとんどの他のパッケージから分離されています。ただし、特定のシステム パッケージについては例外が認められています。この許可リストの変更は、Android の完全な OTA アップデートでのみ行われます。

- 間接的なインターネット アクセス: AICore はインターネットに直接アクセスしません。モデルのダウンロードを含むすべてのインターネット リクエストは、オープンソースの Private Compute Services コンパニオン APK を介してルーティングされます。Private Compute Services 内の API は、プライバシー重視の性質を明示的に示す必要があります。

また、AICore は各リクエストを分離するように構築されており、ユーザーのプライバシーを保護するために、入力データや処理後の出力の結果の記録は保存されません。詳しくは、ブログ投稿「Gemini Nano のプライバシーと安全性の概要」をご覧ください。

AICore で AI 基盤モデルにアクセスするメリット

AICore を使用すると、Android OS で AI 基盤モデルを提供および管理できます。これにより、主に次の理由から、アプリでこれらの大規模モデルを使用する費用が大幅に削減されます。

- デプロイの容易さ: AICore は Gemini Nano の配布を管理し、今後のアップデートを処理します。ネットワーク経由で大規模なモデルをダウンロードしたり更新したりする必要がなく、アプリのディスクとランタイム メモリの予算に影響することもありません。

- 推論の高速化: AICore はデバイス上のハードウェアを活用して推論を高速化します。アプリは各デバイスで最高のパフォーマンスを発揮し、基盤となるハードウェア インターフェースを気にする必要もありません。