Produktneuheiten

Mit der Entwicklervorschau 3 des Android XR SDK für KI-Brillen entwickeln und neue Funktionen für immersive Erlebnisse freischalten

Lesezeit: 4 Minuten

Im Oktober hat Samsung das Galaxy XR auf den Markt gebracht, das erste Gerät mit Android XR. Es ist wirklich beeindruckend, was einige von euch schon alles entwickelt haben. Das sagen einige unserer Entwickler zu ihren Erfahrungen mit Android XR.

Android XR hat uns eine völlig neue Welt eröffnet, in der wir unsere App entwickeln konnten. Teams sollten sich fragen: Was ist die größte, kühnste Version unserer Erfahrung, die wir entwickeln könnten? Das ist Ihre Chance, endlich das zu tun, was Sie schon immer tun wollten, denn jetzt haben Sie die Plattform, die es möglich macht. – Kristen Coke, Calm, Lead Product Manager

Wir haben auch einen ersten Blick auf andere kommende Geräte geworfen, die mit Android XR funktionieren, wie Project Aura von XREAL und stilvolle Brillen von Gentle Monster und Warby Parker.

Um die wachsende Auswahl an XR-Geräten zu unterstützen, kündigen wir die 3. Entwicklervorschau für das Android XR SDK an.

Mit der Entwicklervorschau 3 für das Android XR SDK können Sie nicht nur immersive Erlebnisse für Geräte wie das Galaxy XR entwickeln, sondern auch Augmented-Reality-Erlebnisse für kommende KI-Brillen mit Android XR.

Neue Tools und Bibliotheken für Augmented Reality

Mit der dritten Developer Preview stellen wir die Tools und Bibliotheken bereit, die Sie benötigen, um intelligente Augmented-Reality-Funktionen für KI-Brillen zu entwickeln, die sich per Sprachbefehl steuern lassen. Die KI-Brille ist leicht und tragbar und kann den ganzen Tag getragen werden. Sie können Ihre vorhandene mobile App so erweitern, dass sie die integrierten Lautsprecher, die Kamera und das Mikrofon nutzt, um neue, durchdachte und hilfreiche Nutzerinteraktionen zu ermöglichen. Durch das Hinzufügen eines kleinen Displays auf der KI-Brille können Sie Nutzern Informationen privat präsentieren. KI‑Brillen eignen sich hervorragend für Anwendungen, die die Konzentration und Präsenz eines Nutzers in der realen Welt verbessern können.

Um Augmented Reality-Funktionen auf KI-Brillen zu ermöglichen, führen wir zwei neue, speziell entwickelte Bibliotheken in das Jetpack XR SDK ein:

- Jetpack Projected: Diese Funktion wurde entwickelt, um Mobilgeräte und KI‑Brillen zu verbinden. Sie ermöglicht den Zugriff auf Sensoren, Lautsprecher und Displays von Brillen.

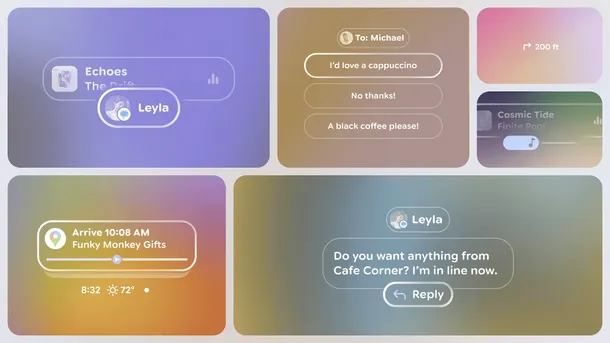

- Jetpack Compose Glimmer: Neue Designsprache und UI-Komponenten zum Erstellen und Gestalten von Augmented Reality-Erlebnissen auf Display-KI-Brillen

Jetpack Compose Glimmer ist eine Demonstration von Design-Best Practices für ansprechende, optisch transparente Augmented-Reality-Erlebnisse. Jetpack Compose Glimmer enthält UI-Komponenten, die für die Eingabemodalität und die Styling-Anforderungen von Display-KI-Brillen optimiert sind. Es wurde mit dem Ziel entwickelt, Klarheit, Lesbarkeit und minimale Ablenkung zu bieten.

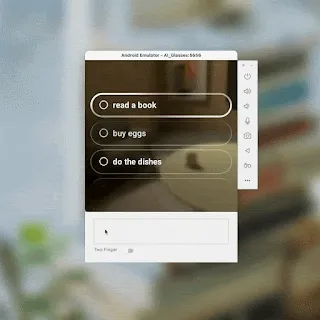

Damit Sie Ihre Jetpack Compose-Glimmer-UI visualisieren und testen können, führen wir in Android Studio den AI Glasses-Emulator ein. Der neue Emulator für KI-Brillen kann brillenspezifische Interaktionen wie Touchpad- und Spracheingabe simulieren.

Neben den neuen Jetpack Projected- und Jetpack Compose Glimmer-Bibliotheken erweitern wir auch ARCore für Jetpack XR, um KI-Brillen zu unterstützen. Wir beginnen mit Bewegungserkennung und geospatialen Funktionen für Augmented Reality-Anwendungen. Das sind genau die Funktionen, mit denen Sie hilfreiche Navigationsfunktionen erstellen können, die sich perfekt für Geräte eignen, die den ganzen Tag getragen werden, wie z. B. KI-Brillen.

Erweiterte Unterstützung für immersive Erlebnisse

Wir investieren weiterhin in die Bibliotheken und Tools, die immersive Erlebnisse für XR-Headsets wie das Samsung Galaxy XR und kabelgebundene XR-Brillen wie das kommende Project Aura von XREAL ermöglichen. Wir haben auf Ihr Feedback gehört und seit der zweiten Entwicklervorschau mehrere häufig gewünschte Funktionen zum Jetpack XR SDK hinzugefügt.

Jetpack SceneCore bietet jetzt dynamisches Laden von glTF-Modellen über URIs und verbesserte Materialien, um zur Laufzeit neue PBR-Materialien zu erstellen. Außerdem wurde die Komponente SurfaceEntity mit vollständiger Unterstützung für Widevine Digital Rights Management (DRM) und neuen Formen erweitert, sodass 360°- und 180°-Videos in Kugeln und Halbkugeln gerendert werden können.

In Jetpack Compose for XR finden Sie neue Funktionen wie die Komponente UserSubspace für das Follow-Verhalten, mit der dafür gesorgt wird, dass Inhalte immer im Blickfeld des Nutzers bleiben, unabhängig davon, wohin er schaut. Außerdem können Sie jetzt räumliche Animationen für flüssige Übergänge wie Ein- oder Ausblenden verwenden. Um ein wachsendes Ökosystem immersiver Geräte mit unterschiedlichen Displayfunktionen zu unterstützen, können Sie jetzt Layoutgrößen als Bruchteile des komfortablen Sichtfelds des Nutzers angeben.

In Material Design for XR passen sich neue Komponenten automatisch räumlich über Overrides an. Dazu gehören Dialogfelder, die räumlich hervorgehoben werden, und Navigationsleisten, die in einen Orbiter übergehen. Außerdem gibt es eine neue SpaceToggleButton-Komponente, mit der sich ganz einfach zwischen dem kompakten und dem vollständigen Bereich wechseln lässt.

In ARCore für Jetpack XR wurden neue Wahrnehmungsfunktionen hinzugefügt, darunter Gesichtserkennung mit 68 Blendshape-Werten, die eine Vielzahl von Gesichtsausdrücken ermöglichen. Sie können auch Eye-Tracking für virtuelle Avatare und Tiefenkarten für realistischere Interaktionen mit der Umgebung eines Nutzers verwenden.

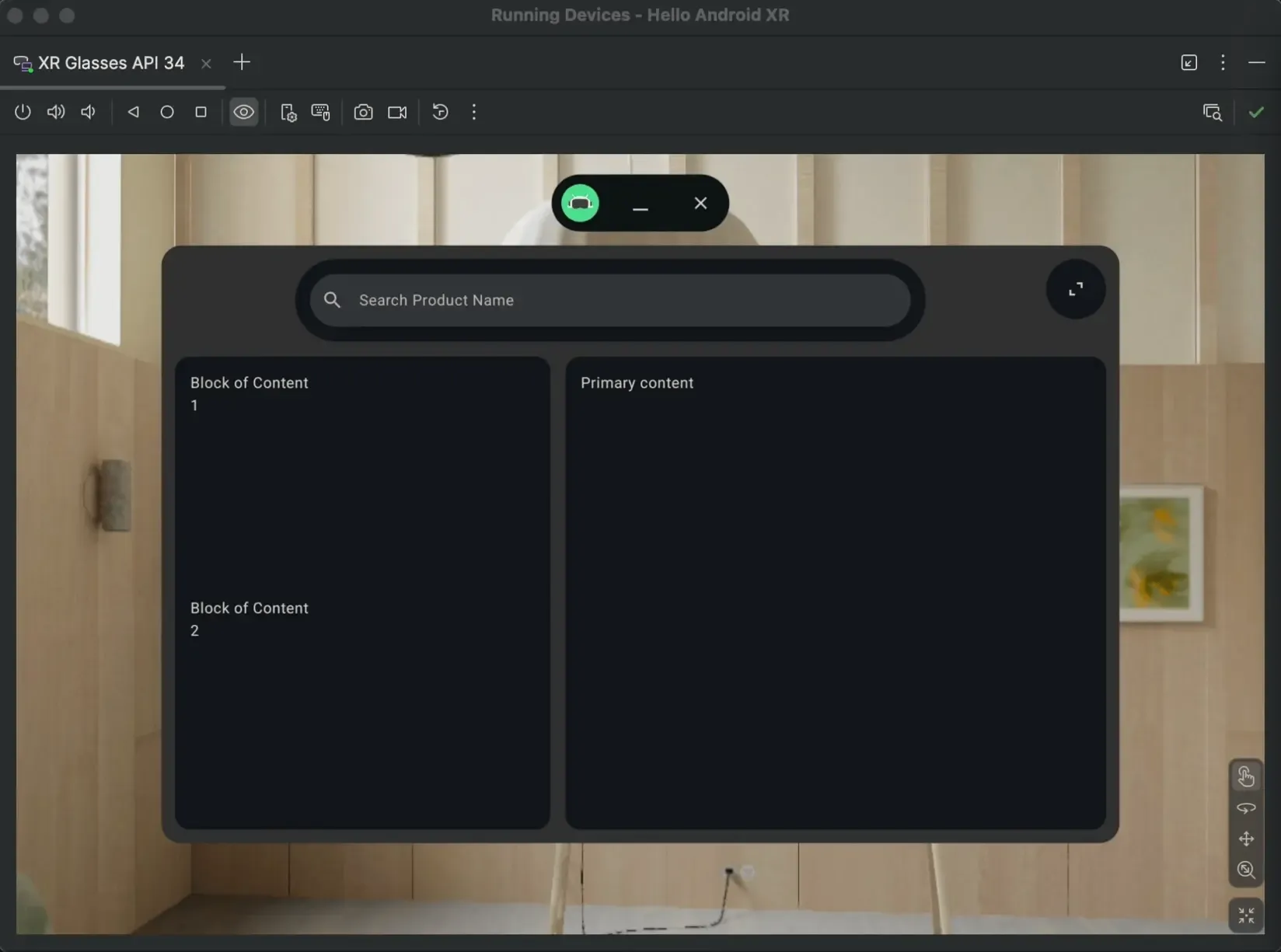

Für Geräte wie Project Aura von XREAL führen wir den XR-Brillen-Emulator in Android Studio ein. Dieses wichtige Tool wurde entwickelt, um Ihnen eine genaue Visualisierung von Inhalten zu ermöglichen. Gleichzeitig werden die Spezifikationen echter Geräte für Sichtfeld, Auflösung und DPI berücksichtigt, um die Entwicklung zu beschleunigen.

Wenn Sie immersive Erlebnisse mit Unity entwickeln, erweitern wir auch Ihre Wahrnehmungsfunktionen im Android XR SDK für Unity. Neben vielen Fehlerkorrekturen und anderen Verbesserungen erweitern wir die Tracking-Funktionen um QR- und ArUco-Codes, planare Bilder und Body-Tracking (experimentell). Außerdem führen wir eine viel gewünschte Funktion ein: das Zusammenfügen von Szenen. So können Sie viel intensiver mit der Umgebung des Nutzers interagieren – Ihre digitalen Inhalte können jetzt von Wänden abprallen und auf Sofas klettern.

Und das ist erst der Anfang. Weitere Informationen finden Sie auf der Seite Immersive Erlebnisse.

Starten Sie noch heute!

Die Entwicklervorschau 3 für das Android XR SDK ist ab heute verfügbar. Laden Sie die aktuelle Android Studio Canary-Version (Otter 3, Canary 4 oder höher) herunter und führen Sie ein Upgrade auf die aktuelle Emulatorversion (36.4.3 Canary oder höher) durch. Unter developer.android.com/xr finden Sie die neuesten Bibliotheken und Beispiele, die Sie für die Entwicklung für die wachsende Auswahl an Android XR-Geräten benötigen. Wir entwickeln Android XR gemeinsam mit euch. Vergessen Sie nicht, unserem Team Feedback, Vorschläge und Ideen mitzuteilen, während Sie Android XR nutzen.

Weiterlesen

-

Produktneuheiten

Heute stellen wir Gemma 4 vor, unser neuestes hochmodernes offenes Modell, das für komplexes Reasoning und autonomes Tool-Calling entwickelt wurde und die Android-Entwicklung noch weiter verbessert.

Matthew McCullough • Lesezeit: 2 Minuten

-

Produktneuheiten

Mit Beta 3 hat Android 17 heute offiziell die Plattformstabilität erreicht. Das bedeutet, dass die API-Oberfläche gesperrt ist. Sie können die letzten Kompatibilitätstests durchführen und Ihre für Android 17 entwickelten Apps im Play Store veröffentlichen.

Matthew McCullough • Lesezeit: 5 Minuten

-

Produktneuheiten

Wir möchten Ihnen die Entwicklung hochwertiger Android-Apps erleichtern und beschleunigen. Dazu stellen wir Ihnen KI-Funktionen zur Verfügung, die Ihre Produktivität steigern.

Matthew McCullough • Lesezeit: 2 Minuten

Auf dem Laufenden bleiben

Lassen Sie sich Woche für Woche die neuesten Informationen zur Android-Entwicklung zusenden.