Wiadomości o usługach

Twórz aplikacje na okulary z AI za pomocą pakietu SDK Android XR w wersji przedpremierowej dla programistów 3 i odblokowuj nowe funkcje, które zapewnią wciągające wrażenia.

Czas czytania: 4 minuty

W październiku firma Samsung wprowadziła na rynek Galaxy XR – pierwsze urządzenie z Androidem XR. Z przyjemnością obserwujemy, co tworzycie. Oto, co niektórzy z naszych deweloperów mówią o swojej przygodzie z Androidem XR.

Android XR otworzył przed nami zupełnie nowy świat, w którym mogliśmy stworzyć naszą aplikację. Zespoły powinny zadać sobie pytanie: jaka jest największa i najbardziej śmiała wersja Twojego doświadczenia, którą możesz stworzyć? To Twoja szansa na realizację tego, co zawsze chciałeś zrobić, ponieważ masz teraz platformę, która Ci to umożliwi. - Kristen Coke, Calm, Lead Product Manager

Pokazaliśmy też pierwsze urządzenia, które będą działać z Androidem XR, takie jak Project Aura od XREAL i stylowe okulary od Gentle Monster i Warby Parker.

Aby obsługiwać rosnącą liczbę urządzeń XR, udostępniamy trzecią wersję przedpremierową pakietu SDK Android XR dla programistów.

Dzięki trzeciej wersji przedpremierowej pakietu SDK Android XR dla programistów możesz nie tylko tworzyć wciągające aplikacje na urządzenia takie jak Galaxy XR, ale też aplikacje wykorzystujące rzeczywistość rozszerzoną na nadchodzące okulary z AI z Androidem XR.

Nowe narzędzia i biblioteki do tworzenia rozszerzonych doświadczeń

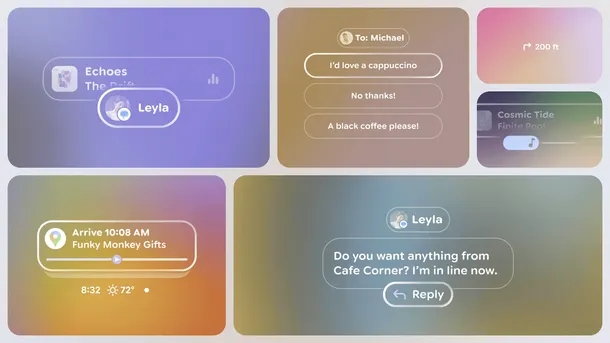

W wersji przedpremierowej 3 udostępniamy narzędzia i biblioteki potrzebne do tworzenia inteligentnych i bezobsługowych rozszerzonych doświadczeń dla okularów z AI. Okulary AI są lekkie i poręczne, więc można je nosić przez cały dzień. Możesz rozszerzyć istniejącą aplikację mobilną, aby wykorzystać wbudowane głośniki, kamerę i mikrofon do zapewnienia nowych, przemyślanych i przydatnych interakcji z użytkownikiem. Dzięki niewielkiemu wyświetlaczowi na okularach AI Glasses możesz prywatnie prezentować informacje użytkownikom. Okulary AI doskonale sprawdzają się w przypadku funkcji, które pomagają użytkownikowi skupić się na otaczającym go świecie i w nim uczestniczyć.

Aby umożliwić korzystanie z rozszerzonej rzeczywistości na okularach z AI, wprowadzamy 2 nowe, specjalnie opracowane biblioteki do pakietu Jetpack XR SDK:

- Jetpack Projected – stworzony, aby połączyć urządzenia mobilne i okulary AI. Umożliwia dostęp do czujników, głośników i wyświetlaczy w okularach.

- Jetpack Compose Glimmer – nowy język projektowania i komponenty interfejsu do tworzenia i stylizowania rozszerzonych funkcji na wyświetlaczu okularów AI

Jetpack Compose Glimmer to demonstracja sprawdzonych metod projektowania pięknych, przezroczystych optycznie doświadczeń w rozszerzonej rzeczywistości. Komponenty interfejsu zoptymalizowane pod kątem trybu wprowadzania i wymagań dotyczących stylu wyświetlania okularów z AI, Jetpack Compose Glimmer został zaprojektowany z myślą o wyrazistości, czytelności i minimalnym rozpraszaniu uwagi.

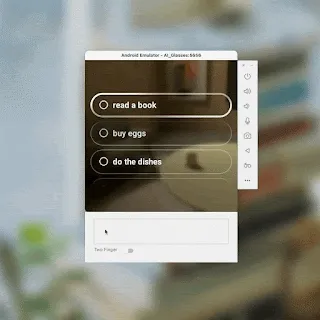

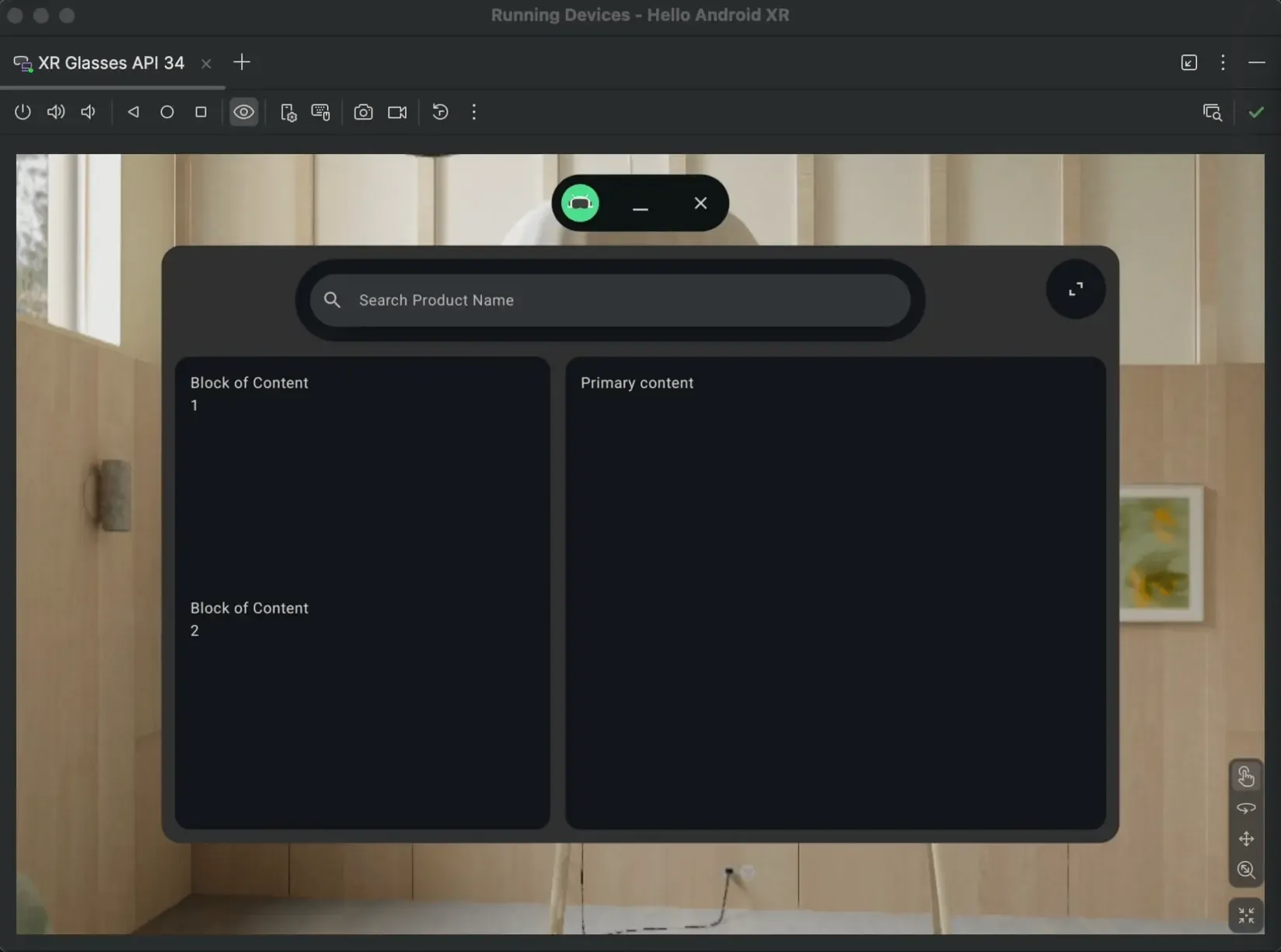

Aby ułatwić wizualizację i testowanie interfejsu Glimmer w Jetpack Compose, wprowadzamy w Androidzie Studio emulator okularów AI. Nowy emulator okularów AI może symulować interakcje charakterystyczne dla okularów, takie jak touchpad i głosowe wprowadzanie tekstu.

Oprócz nowych bibliotek Jetpack Projected i Jetpack Compose Glimmer rozszerzamy też ARCore dla Jetpack XR, aby obsługiwać okulary AI. Zaczynamy od śledzenia ruchu i funkcji geoprzestrzennych, które pozwalają tworzyć rozszerzone środowiska. Są to funkcje, które umożliwiają tworzenie przydatnych rozwiązań nawigacyjnych idealnych do urządzeń noszonych przez cały dzień, takich jak okulary AI.

Rozszerzanie obsługi realistycznych doświadczeń

Nadal inwestujemy w biblioteki i narzędzia, które umożliwiają immersyjne doświadczenia na goglach XR, takich jak Samsung Galaxy XR, oraz przewodowych okularach XR, takich jak nadchodzący Project Aura od XREAL. Wysłuchaliśmy Waszych opinii i od czasu wersji przedpremierowej 2 dodaliśmy do Jetpack XR SDK kilka bardzo oczekiwanych funkcji.

Jetpack SceneCore ma teraz dynamiczne wczytywanie modeli glTF za pomocą identyfikatorów URI i ulepszoną obsługę materiałów, co umożliwia tworzenie nowych materiałów PBR w czasie działania. Dodatkowo komponent SurfaceEntity został wzbogacony o pełną obsługę zarządzania prawami cyfrowymi Widevine (DRM) i nowe kształty, dzięki czemu może renderować filmy 360° i 180° w sferach i półkulach.

W Jetpack Compose na potrzeby XR znajdziesz nowe funkcje, takie jak komponent UserSubspace, który umożliwia śledzenie zachowań użytkownika i zapewnia, że treści pozostaną w jego polu widzenia niezależnie od tego, gdzie patrzy. Możesz też używać animacji przestrzennych, aby uzyskać płynne przejścia, takie jak przesuwanie czy zanikanie. Aby obsługiwać rozwijający się ekosystem urządzeń immersyjnych o różnych możliwościach wyświetlania, możesz teraz określać rozmiary układu jako ułamki wygodnego pola widzenia użytkownika.

W Material Design for XR nowe komponenty automatycznie dostosowują się przestrzennie za pomocą zastąpień. Obejmują one okna dialogowe, które są wyświetlane w przestrzeni, oraz paski nawigacyjne, które wysuwają się w Orbiterze. Dodatkowo dostępny jest nowy komponent SpaceToggleButton, który ułatwia przełączanie się między pełną przestrzenią a innymi widokami.

W ARCore na Jetpack XR dodaliśmy nowe funkcje percepcji, w tym śledzenie twarzy z 68 wartościami kształtu, które otwierają świat gestów twarzy. Możesz też używać śledzenia wzroku do sterowania wirtualnymi awatarami oraz map głębi, aby umożliwić bardziej realistyczne interakcje ze środowiskiem użytkownika.

W przypadku urządzeń takich jak Project Aura od XREAL wprowadzamy w Androidzie Studio emulator okularów XR. To niezbędne narzędzie zostało zaprojektowane, aby zapewnić dokładną wizualizację treści przy jednoczesnym dopasowaniu specyfikacji rzeczywistego urządzenia do pola widzenia, rozdzielczości i DPI, co przyspiesza proces tworzenia.

Jeśli tworzysz wciągające doświadczenia za pomocą Unity, rozszerzamy też Twoje możliwości percepcji w pakiecie Android XR SDK dla Unity. Oprócz wielu poprawek błędów i innych ulepszeń rozszerzamy możliwości śledzenia o kody QR i ArUco, obrazy płaskie oraz śledzenie ciała (eksperymentalne). Wprowadzamy też bardzo oczekiwaną funkcję: siatkę sceny. Umożliwia to znacznie głębsze interakcje ze środowiskiem użytkownika – Twoje treści cyfrowe mogą teraz odbijać się od ścian i wspinać się na kanapy.

A to dopiero wierzchołek góry lodowej. Więcej informacji znajdziesz na stronie elementów immersyjnych.

Zacznij już dziś!

Dostępna jest już trzecia wersja przedpremierowa pakietu SDK Android XR dla programistów. Pobierz najnowszą wersję Android Studio Canary (Otter 3, Canary 4 lub nowszą) i zaktualizuj ją do najnowszej wersji emulatora (36.4.3 Canary lub nowszej), a następnie wejdź na stronę developer.android.com/xr, aby rozpocząć korzystanie z najnowszych bibliotek i przykładowych aplikacji potrzebnych do tworzenia aplikacji na rosnącą liczbę urządzeń z Androidem XR. Tworzymy Androida XR razem z Tobą. Nie zapomnij podzielić się z naszym zespołem opiniami, sugestiami i pomysłami w trakcie korzystania z Androida XR.

Czytaj dalej

-

Wiadomości o usługach

Dziś rozszerzamy możliwości programowania na Androida dzięki Gemmie 4, naszemu najnowszemu, zaawansowanemu modelowi otwartemu, który został zaprojektowany z myślą o złożonym rozumowaniu i autonomicznym wywoływaniu narzędzi.

Matthew McCullough • Czas czytania: 2 minuty

-

Wiadomości o usługach

Wersja beta 3 Androida 17 osiągnęła dziś oficjalnie stabilność platformy. Oznacza to, że interfejs API jest zablokowany. Możesz przeprowadzić ostateczne testy zgodności i przesłać do Sklepu Play aplikacje przeznaczone na Androida 17.

Matthew McCullough • Czas czytania: 5 minut

-

Wiadomości o usługach

Chcemy, aby tworzenie wysokiej jakości aplikacji na Androida było szybsze i łatwiejsze. Jednym ze sposobów na zwiększenie Twojej produktywności jest udostępnienie Ci AI.

Matthew McCullough • Czas czytania: 2 minuty

Bądź na bieżąco

Otrzymuj co tydzień najnowsze informacje o tworzeniu aplikacji na Androida na swoją skrzynkę odbiorczą.